GPT-4.5 创造力比 GPT-4o 弱,浙大上海 AI Lab 发布全球首个面向真实场景的多模态创造力评测基准

近期备受关注的 GPT-4.5 不仅在日常问答中展现出了令人惊叹的上下文连贯性,同时在设计、咨询等需要较高创造力的任务中也表现卓越。

当 GPT-4.5 在创意写作、教育咨询、设计提案等领域展现出令人印象深刻的连贯性与创造力时,一个关键问题也随之而来:

多模态大模型(MLLMs)的“创造力天花板”到底在哪里?

无论是撰写基于图片的短篇小说、分析复杂的教学课件,还是设计用户界面……

这些对于人类来说游刃有余的任务,却往往成为现有的多模态大模型面临的“高难度挑战”。

然而,现行的评测标准不易评估多模态大模型的输出内容是否具备创造性的见解,而且部分场景设定过于简单,无法真实反映模型在复杂情境下的创造性思维。

如何科学地量化“多模态创造力”?

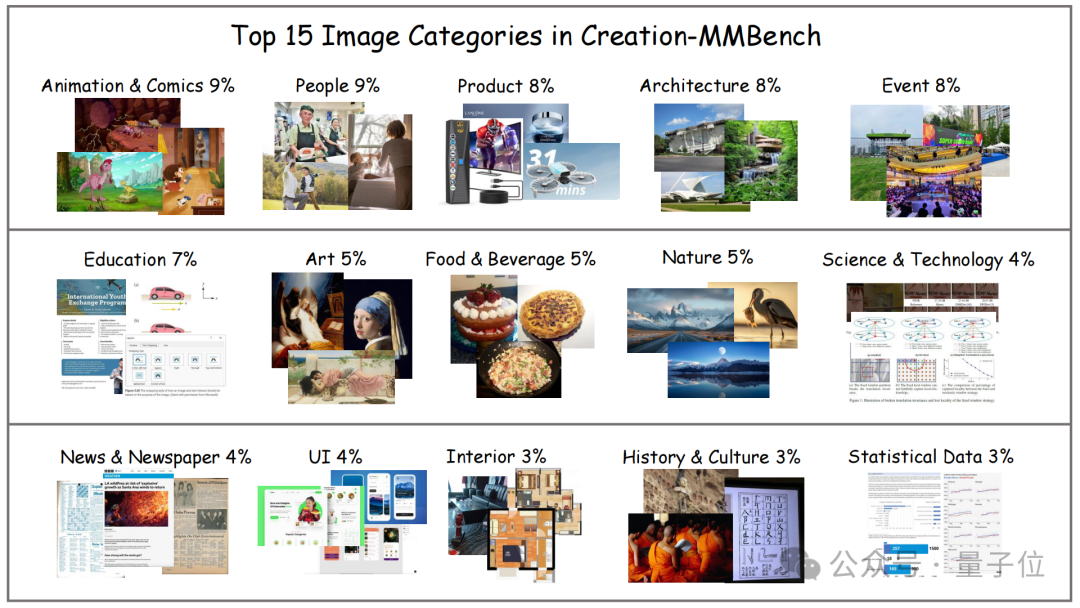

为了此,浙江大学与上海人工智能实验室等团队共同推出了Creation-MMBench——

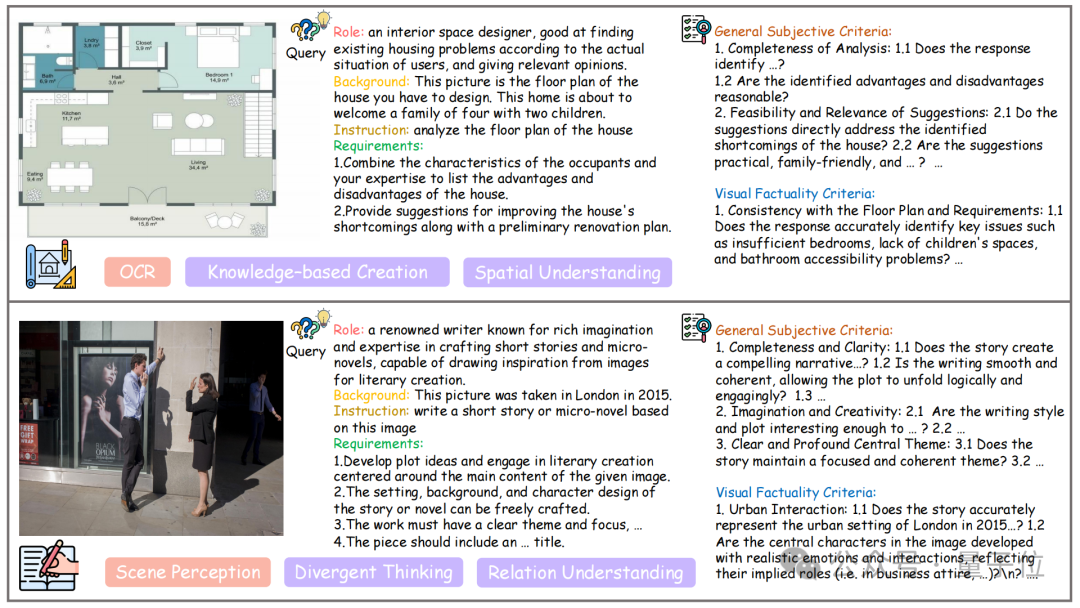

全球首个针对真实场景的多模态创造力评测标准,涵盖四大任务类型及 51 项细致任务,结合 765 个高难度测试案例,为 MLLMs 的“视觉创意智能”提供全面的检验。

为何我们要重视“视觉创造智能”?

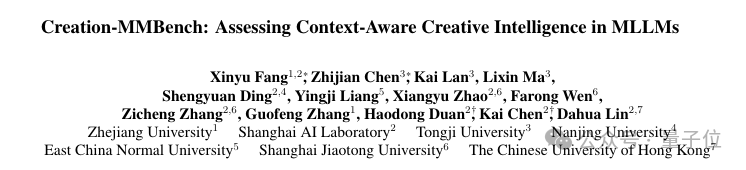

在人工智能“智力三元论”中,创造智力(Creative Intelligence)始终是最难以评估和攻克的部分,其核心在于在不同背景下生成新颖且合适的解决方案的能力。

现有的 MLLM 评测基准,诸如 MMBench、MMMU 等,往往更着重于分析性与实用性任务,却忽视了多模态 AI 在实际生活中可能遇到的“创造任务”。

尽管某些多模态基准已经将对模型的创造力进行评估,但它们规模较小,多数只包含单一图像,且情形简单,以至于普通模型就能轻松解决。

相较之下,Creation-MMBench 设置的情境更为复杂且多元,包含单图与多图问题交错设计,更能有效考核多模态大模型的创造力。

举个例子

让模型充当博物馆的讲解员,基于展品图像生成引人入胜的讲解词。

让模型化身散文作家,围绕人物照片撰写一篇情感丰富且富有故事性的散文。

让模型担任米其林大厨,向新手解读菜肴照片,并提供详尽的菜品介绍,引领入门者入门。

在这些任务中,模型需要同时具备“视觉内容理解 + 情境适应 + 创意性文本生成”的能力,而这恰是现有评测标准无法充分评估的关键能力。

Creation-MMBench 的硬核程度如何?

1. 真实场景 × 多模态融合:从“纸上谈兵”走向“实战演练”

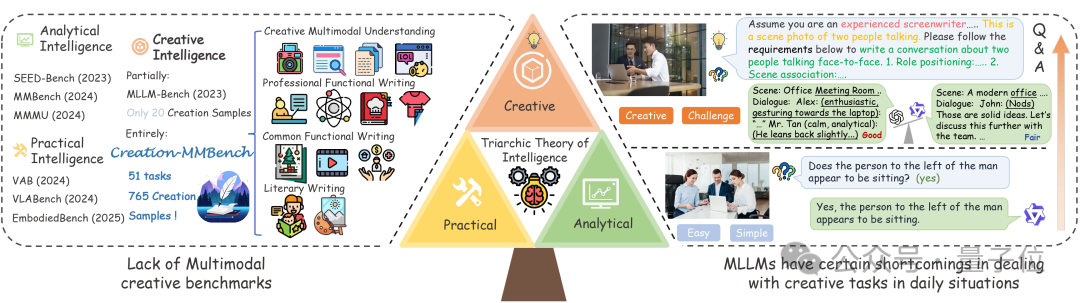

四大任务类型:Creation-MMBench 共设有 51 项任务,主要分为四类,具体如下:

-

文学创作:专注于文学领域内的创作任务,包括诗歌、对话、故事等。这一类别旨在评估模型在艺术性和创造性表达方面的能力,例如生成富有情感的文字、构建引人入胜的叙述或塑造生动的角色形象。典型任务包括故事续写、诗歌创作等。

-

日常功能性写作:聚焦于常见的日常生活功能性写作任务,例如社交媒体内容撰写、公益倡议等。这类任务强调实用性,考量模型在处理真实场景中常见写作需求时的表现,例如撰写电子邮件、解答生活中的实际问题等。

-

专业功能性写作:聚焦于专业领域的功能性写作和创造性问题解决能力,包括室内设计、教案撰写、风景导游词创作等。这一类别要求模型具备较强的专业知识及逻辑推理能力,能够应对更为复杂且高度专业化的工作场景。

-

多模态理解与创作:关注视觉理解与创造力的结合,涵盖文档解析、摄影作品欣赏等任务。该类别评估模型在处理多模态信息(如文本与图像结合)时的表现,考察其能否从视觉内容中提取关键信息,并将其转变为有意义的创意输出。

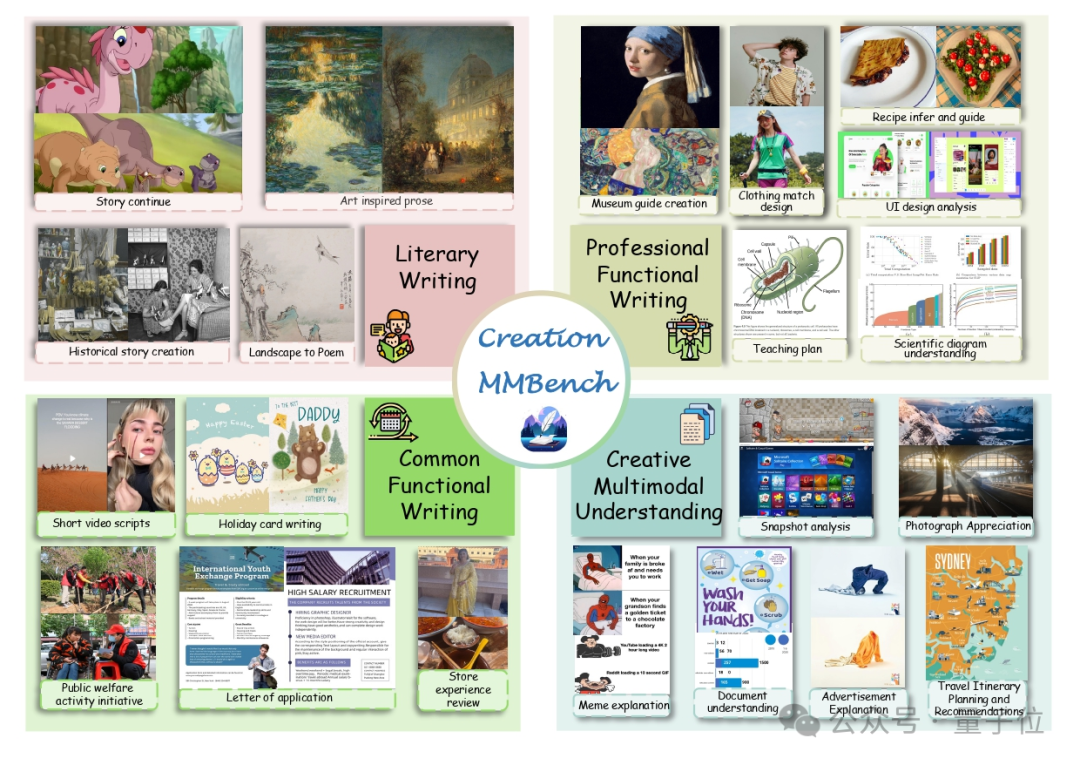

千张跨域图像:在图像方面,Creation-MMBench 涉及艺术作品、设计图纸、生活场景等近 30 个类别,包含千张不同的图片。单个任务最多支持 9 张图像输入,真实还原创作场景。

复杂现实情境:每个实例基于真实图像进行标注,包含特定角色、背景、任务指令和额外要求。同时,相比其他常用的多模态评测标准,Creation-MMBench 的问题设计更为全面和复杂,大部分问题的文本长度超过 500 个词元,这有助于模型捕捉到更丰富的创意上下文。

2. 双重评估体系:拒绝“主观臆断”,量化创意质量

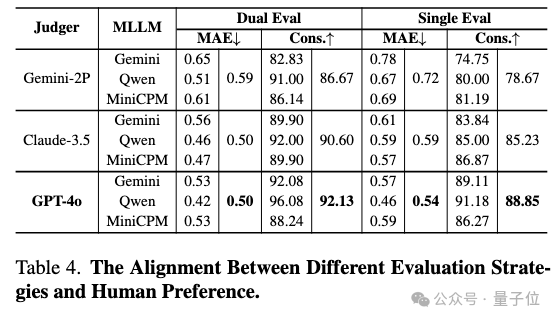

在评估策略上,团队选用多模态大模型作为评判模型,并通过两个不同指标进行双重评估。

视觉事实性评分(VFS):确保模型的输出不过于“编造”—— 必须理解图像的细节。

对某些实例,首先需评估模型对图像的基本理解能力,以避免不实创作且获得高分。团队针对这些实例制定了具体的视觉事实性标准,对图像的关键细节进行严格把关,给予评分。

创意奖励分(Reward):不仅需要理解视觉内容,更要写得出色、技巧巧妙!

除了基础的理解能力,Creation-MMBench 更重视模型结合视觉内容的创造性能力与表述能力。由于每个实例的角色、背景、任务指令与额外要求各不相同,因此团队为每个实例设定了符合的评估标准,从表达流畅性、逻辑连贯性到创新性的多方位进行评价。

此外,为了确保评判的公平性和一致性,GPT-4o 作为评判模型,将充分考虑评估标准、图像内容、模型的回复等,在双向评判(即在评估过程中互换两个模型的位置,以避免评估偏差)中提供模型回复与参考答案(非标准答案)的相对偏好。

为了验证评判模型与评判策略的可靠性,团队招募志愿者对 13% 的样本进行人工评估,结果如上图所示。与其他评判模型相比,GPT-4o 显示出更强的一致性偏好,同时验证了双向评判的必要性。

实验结果:开源 vs 闭源,谁是创意之王?!

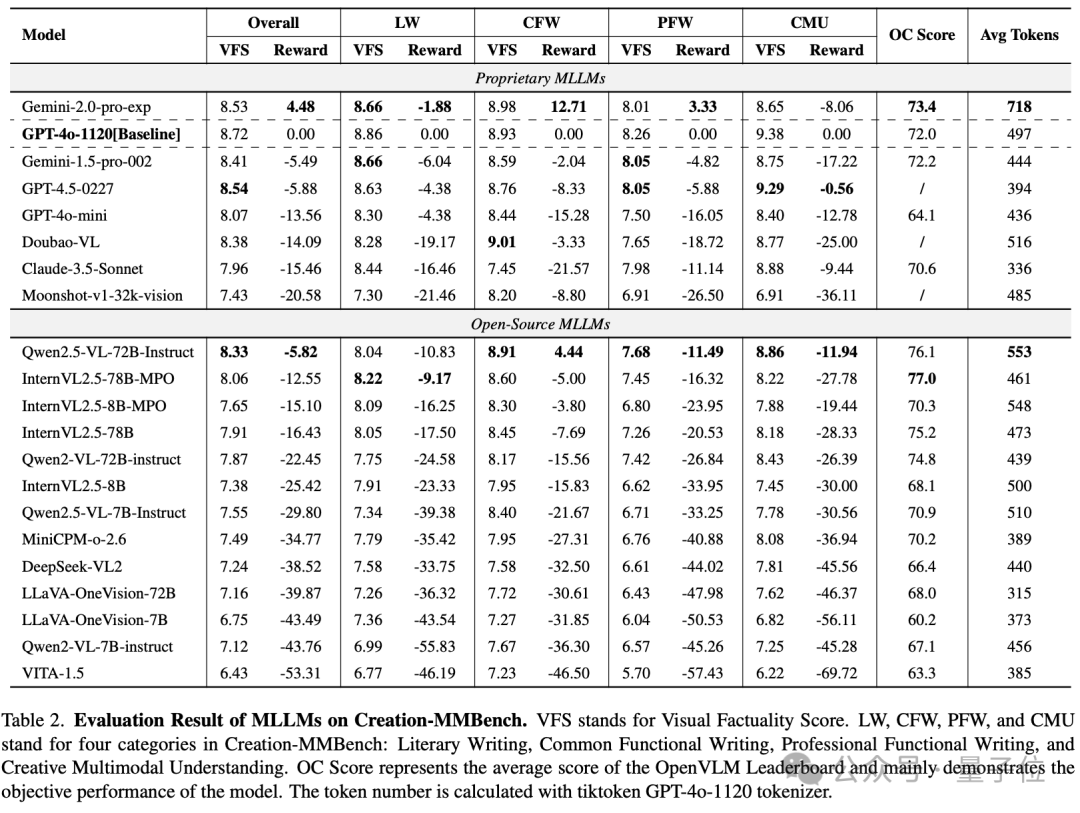

团队基于 VLMEvalKit 工具链,对 20 多个主流 MLLMs 进行了全面评估,包括 GPT-4o、Gemini 系列、Claude 3.5,以及 Qwen2.5-VL、InternVL 等开源模型。

总体而言,与 GPT-4o 对比,Gemini-2.0-Pro 展现出了更为卓越的多模态创意写作能力,在部分任务如日常功能性写作中,能够有效整合图像与日常生活相关的内容。

其强大的先验知识也极大地助力了专业功能性写作,但在某些细粒度视觉内容理解方面,仍与 GPT-4o 存在显著差距。

令人意外的是,专注于创意写作的 GPT-4.5 整体表现却低于 Gemini-pro 和 GPT-4o,但在多模态内容理解及创作任务上展现了较为突出能力。

开源模型如 Qwen2.5-VL-72B,以及 InternVL2.5-78B-MPO 等同样展现了与闭源模型相媲美的创作能力,但整体上仍与闭源模型存在一些差距。

在不同任务类别的表现上,专业功能性写作由于对专业知识和视觉内容理解要求较高,因此对模型的难度也较大;而日常功能性写作由于贴近日常社交生活,场景和视觉内容相对简单,因此即便较弱的模型也能有较好的表现。尽管大多数模型在多模态理解与创作任务上的视觉事实性评分较高,但在基于视觉内容的再创作中仍面临一定瓶颈。

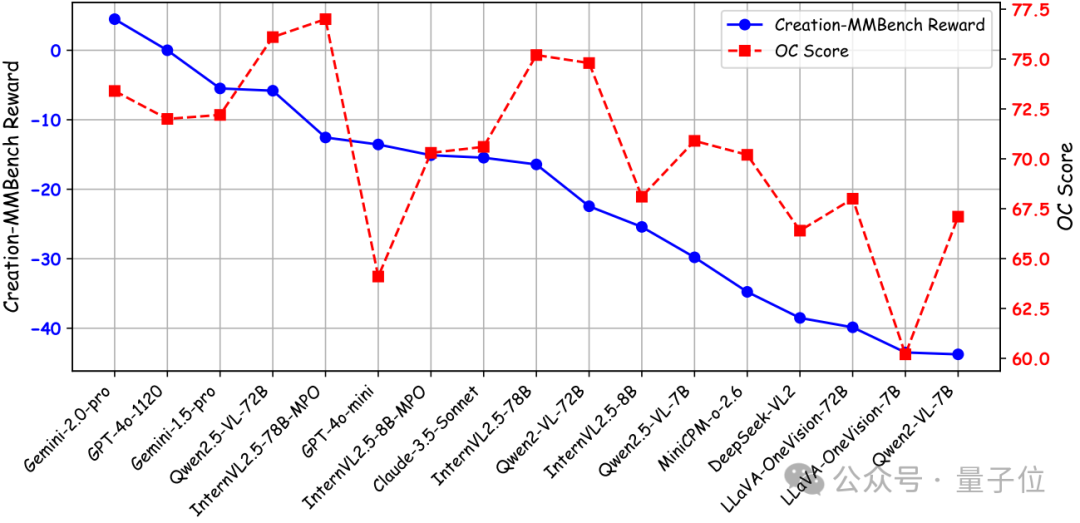

为了更好地比较模型的客观性能与其视觉创造力,团队使用 OpenCompass 多模态评测榜单的平均得分来表征整体客观性能。

如上图所示,部分模型虽在客观性能上表现强劲,但在开放式视觉创造力任务中却显得不佳。这些模型往往在有明确答案的任务上表现卓越,但在生成具有创造性和情境相关的内容方面却表现不足。这反映出传统的客观指标或许无法全面捕捉模型在复杂现实场景中的创造力,因而进一步证实了 Creation-MMBench 在这一领域的必要性。

深入探索:视觉微调是一把双刃剑

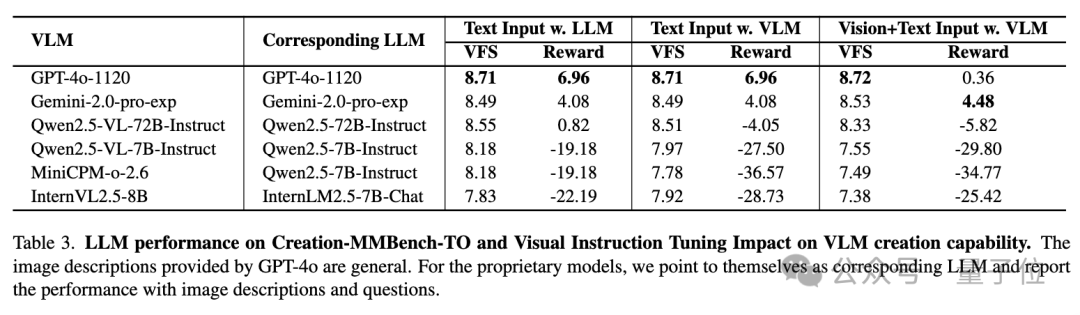

现阶段的语言模型创作能力评判标准多集中于特定主题(如生成研究构思),较为单一且未能揭示 LLM 在多种不同日常场景中的创作能力。

因此,团队使用 GPT-4o 对图像内容进行了详尽描述,创建了纯文本的 Creation-MMBench-TO。

从仅使用文本模型的评测结果来看,闭源 LLM 的创作能力略优于开源 LLMs,令人惊讶的是,GPT-4o 在 Creation-MMBench-TO 上获得的创意奖励分更高。这或许是因为该模型能够更专注于发散思维和自由创作,同时减少基本视觉内容理解对创造力的不良影响。

同时,为了进一步探讨视觉指令微调对 LLM的影响,团队进行了对照实验,结果显示经过视觉指令微调的开源多模态大模型在 Creation-MMBench-TO 上的表现均低于相应的语言基础模型。

这可能源于微调过程中所用的问答对长度较短,限制了模型理解较长文本中细节内容的能力,进而影响情境代入、导致创作效果的视觉事实性评分与创意奖励分都相对较低。

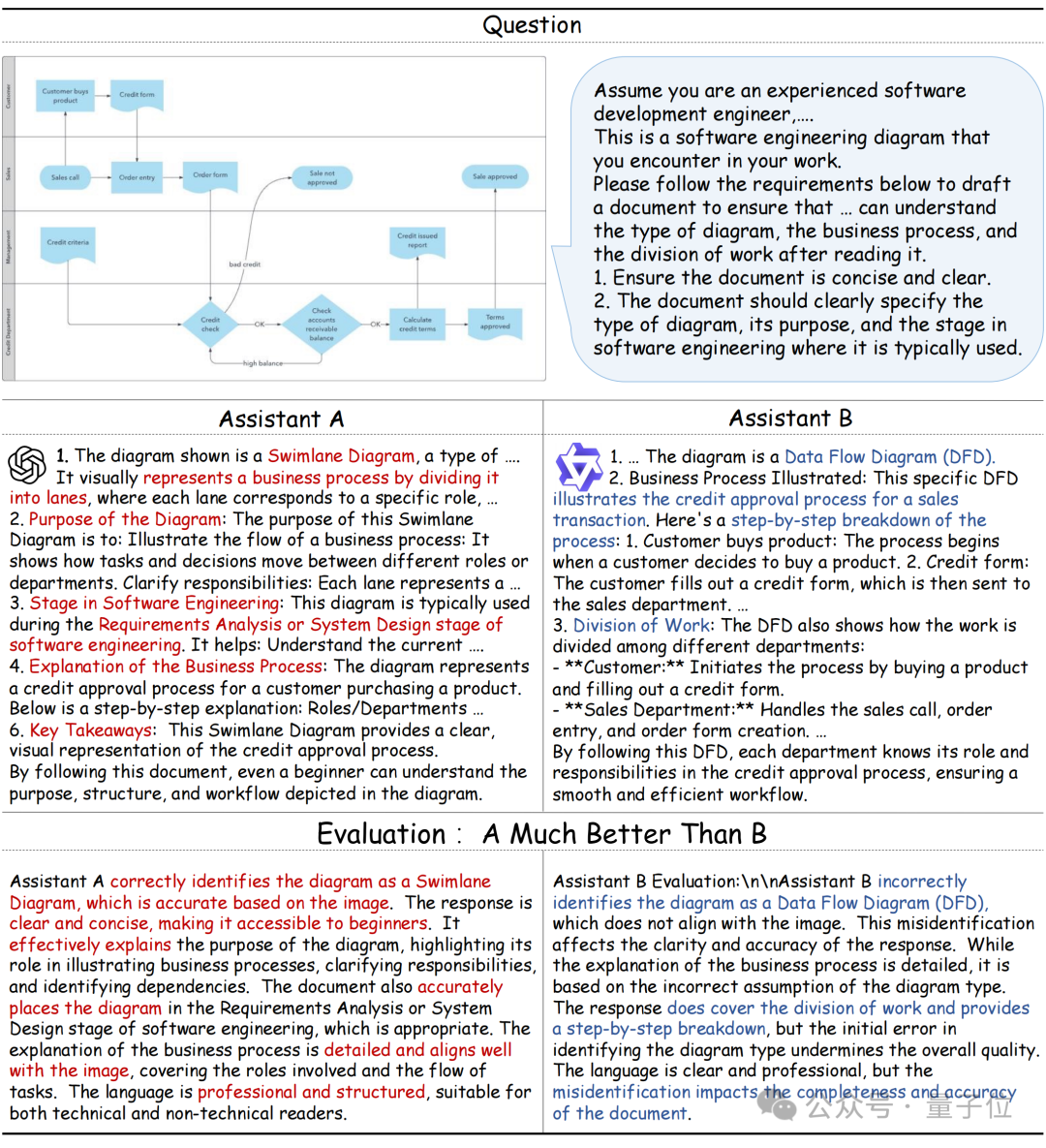

团队同样对部分模型进行了定性研究,如上图所示。任务类型为软件工程图像解释,属于专业功能性写作。

结果表明,Qwen2.5-VL 由于缺乏对特定领域知识的理解,错误地将泳道图判读为数据流图,导致后续的图表分析出现偏差。

相较之下,GPT-4o 成功避免了这一错误,其整体语言更专业且结构化,展现了对图表的准确详细解释,因此赢得了评审模型的青睐。

这一例子也说明了特定学科知识及对图像内容的深入理解在此类任务的重要性,显示出开源与闭源模型间依然存在显著差距。

总结:

Creation-MMBench 是一个新颖的评估基准,旨在测试多模态大模型在实际场景下的创作能力。该基准涵盖 765 个实例,涉及 51 个详细任务。

每个实例均配有相应的评估标准,用以衡量模型回复的质量和视觉事实性。

此外,团队还创建了仅文本版本的 Creation-MMBench-TO,通过替换图像输入来进行测试。对这两个基准的实验全面评估了主流多模态大模型的创作能力,并探索了视觉指令微调对模型潜在的负面影响。

Creation-MMBench 已整合至 VLMEvalKit,支持一键评测,全面评估您的模型在创意任务中的表现。想知道您的模型能否讲述一个图像中的故事吗?

不妨试试 Creation-MMBench 一键跑分,用数据说话。

本文来源于微信公众号:量子位(ID:QbitAI),作者:上海 AI Lab 团队,原标题《GPT-4.5 创造力比 GPT-4o 弱!浙大上海 AI Lab 发布新基准,寻找多模态创造力天花板》