移动通信领域有了新 SOTA:华为出品,精准预测用户行为

专注于解决电信行业用户行为建模的挑战,华为 GTS 部门的 AI 算法团队推出了 GTS-LUM,实现了对移动通信用户行为的精准分析和多步预测,实验结果显著优于 Meta 的 HSTU 及字节的 HLLM。

GTS-LUM,即 Global Technical Service-Large User Model,主要包含以下创新点:

基于海量用户行为序列数据进行自监督学习、多模异构的 Encoder-Adapter-LLM Decoder 架构、Q-former 语义空间与业务空间知识的对齐、创新的多尺度时序处理机制,以及对多用户运营场景的后训练,能够精准捕捉到用户在业务层面的浅层语义。

实验结果表明,GTS-LUM 在所有评估指标上均显著超过基线模型,创下了该领域的新 SOTA。

以下是更多详细信息。

GTS-LUM 方法解析

随着电信市场的渗透率接近饱和,挖掘存量用户的价值和用户留存已成为运营商的核心战略。

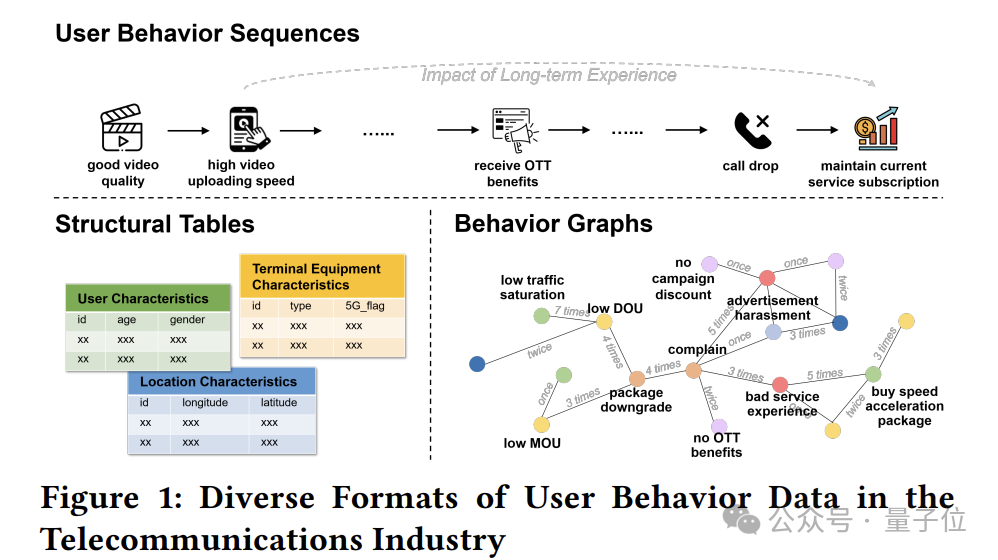

电信用户的网络行为产生了海量数据(每日达到 PB 级),形成了一种新型数据模态。

传统上,运营商使用传统的机器学习方法来学习用户行为,但面临着模型规模的限制,导致预测精度逐渐下降。与成熟的互联网推荐场景不同,电信场景的特殊性在于:

用户的长期决策机制

电信服务作为社会基础设施,具有强烈的连续性需求,导致用户决策表现出长期周期特征。

用户的关键决策行为(如套餐更改、携号转网)更多受到长期服务体验(如网络稳定性、资费合理性等)的驱动,这与互联网场景中的短期兴趣驱动机制形成了本质差异。

这种决策特征使得传统序列建模方法在基于近期行为的采样策略上面临挑战,直接应用可能导致关键历史信息的流失,从而影响预测精度。

多模异构数据特点

与互联网场景中以历史用户-商品交互序列为基础、预测用户短期商品交互不同,电信用户的数据输入与预测目标具有显著的异构特性,主要体现在:

-

行为打点多样性:包括用户-用户、产品、位置、渠道和网元交互等信息;

-

时间粒度层次性:涵盖秒级(如实时信令)、日级(如业务办理)、月级(如账单)等多个尺度;

-

目标异质性:涉及用户流失预警、套餐升级预测和营销响应建模等多种运营任务。

这种复杂性使得现有技术面临几个瓶颈:

1、跨时间尺度建模不足:目前的序列建模方法缺乏有效的时间处理机制,以捕捉用户在日、周、月等多种时间尺度下的长期行为演变模式;

2、多模异构数据表征局限:当前互联网推荐技术通常依赖商品的文本描述,难以充分利用电信领域多样化的数据模态来增强用户表征能力,直接应用存在异构空间对齐的问题;

3、目标分离明显:电信领域现有方案通常对流失预警、套餐升级预测等运营任务进行独立建模,效率低下,缺乏统一的模型架构来提取和更有效地关联用户表征。

因此,华为 GTS 部门 AI 算法团队提出了 GTS-LUM。

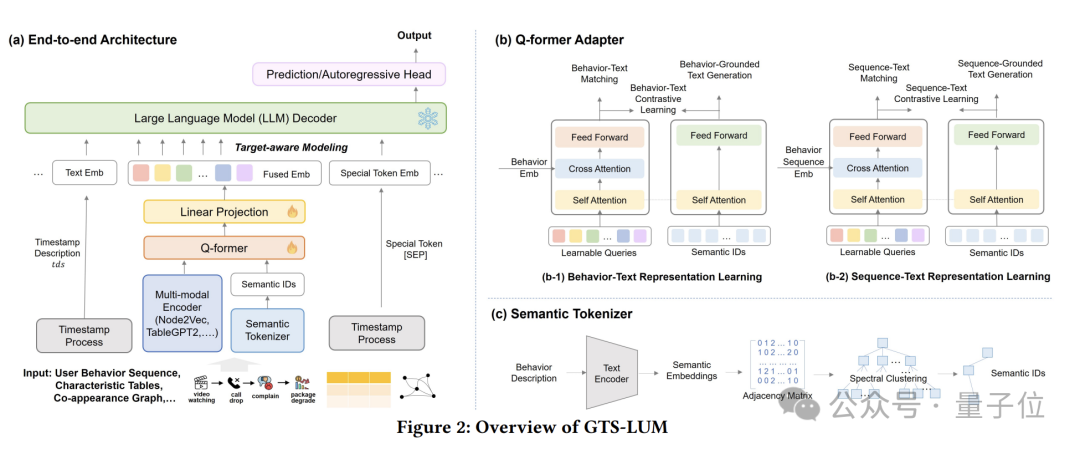

GTS-LUM 的技术架构如下图所示:

多尺度时序处理机制

GTS-LUM 基于多层级时间划分和融合语义策略,通过构建“时段-周期”的语义描述来优化用户行为序列建模。

具体而言,基础层级将每日划分为若干典型时间区间(如早高峰、午间时段等);再在周期层级中叠加工作日/周末等周级维度特征,形成对用户行为事件的复合语义描述。用户行为随后按照指定的时间切片进行处理与汇聚。

在同一时间切片内,用户行为的序列组织时,在序列开端嵌入对应的时段-周期语义描述,并在序列末尾添加特殊分隔符 [SEP] 作为行为片段的边界标识。

这一设计通过粗粒度的业务时间特征与细粒度的行为位置关系的协同建模,形成具有时间感知能力的用户行为序列。

多模异构框架

GTS-LUM 构建了多模态协同的用户行为嵌入框架,精准捕捉用户业务层面的浅层语义。

在语义特征维度,利用任何时间切片内对用户与产品、位置、渠道的交互行为进行处理,以形成“一句话”描述,继而基于预训练语言模型获取文本向量嵌入,并在语义空间中执行谱聚类,从而提取可解释的行为语义编码。

在业务特征维度,采用 Node2Vec 算法处理用户-用户交互等图数据,以及使用 TableGPT2 框架处理终端设备、地理位置等属性维表,生成多模态业务嵌入向量。

本方法的核心创新在于引入了基于 Q-Former 适配器的跨模态对齐机制:

通过交叉注意力层自动筛选与当前语义最相关的多模态业务特征,并利用共享的自注意力层构建业务特征空间和语义空间之间的潜在映射关系,最终通过对比学习任务实现跨模态知识对齐。

值得注意的是,论文中创新性地为 Q-Former 引入了额外的训练任务,包括序列片段-文本匹配、序列片段-文本对比学习和序列片段-文本生成,使其同时具备多模态对齐器与用户长期兴趣压缩器的双重功能。

目标感知建模

GTS-LUM 进一步优化了用户表征学习过程,通过目标感知建模突出了与任务场景最相关的历史行为。

与传统推荐模型的目标后置范式不同,GTS-LUM 将预测标签置于行为序列的起始位置,利用 LLM 的因果注意力机制实现双阶段优化:

在注意力计算阶段,目标标签作为先验条件动态调整历史行为的注意力权重分布;在表征生成阶段,基于 Decoder 的自回归架构实现渐进式特征优化,通过多步解码过程不断调整用户表征向量。

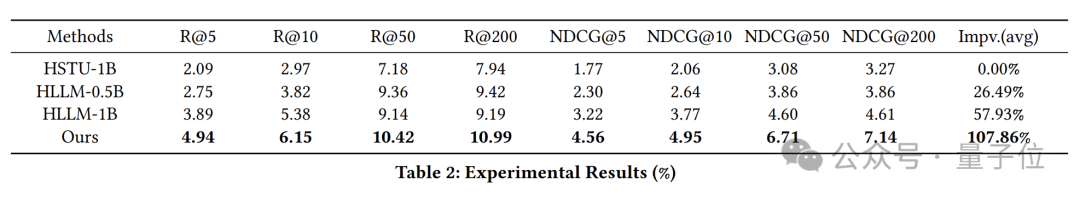

工业级验证效果

在某省级运营商的真实场景中选取约 20 万用户的数据量,在 Ascend 910B2 NPU 上进行训练与推理,实验结果显示 GTS-LUM 的表现非常出色。

GTS-LUM 与业界其他方案的对比如下:

GTS-LUM 在所有评估指标上均显著优于基线模型。

结果表明,尽管典型推荐模型在实验室数据中效果良好,但在涉及领域特定复杂性的工业级数据集上,性能会明显下降。

具体来说,GTS-LUM 相对于 Meta@HSTU 方案提升了平均 107.86%,相较于 ByteDance@HLLM 方案提升了 31.38%,这些改进凸显了融合多模态输入的重要性,以及将开放世界知识与特定业务知识进行对齐的必要性。

更多实验结果可参见论文。

GitHub 链接:https://github.com/zzzzztw/GTS-LUM/blob/main/GTS-LUM.pdf

本文来自微信公众号:量子位(ID:QbitAI),作者:华为 GTS 部门 AI 算法团队