谷歌 DeepMind 闭关修炼《我的世界》:自学成才挖钻石,成果登 Nature

AI 迎来了新一轮的进化,它可以在没有任何人类数据支持的情况下,自主游玩《我的世界》并成功找到钻石!

近期发表在《Nature》期刊上的一篇论文中,谷歌的 DeepMind 智能系统通过纯自我学习,实现了钻石收集的目标。

论文链接:https://www.nature.com/articles/s41586-025-08744-2

对此,DeepMind 的计算机科学家 Danijar Hafner 表示:「Dreamer 是一个重要的里程碑,表明 AI 在迈向通用人工智能方面又向前迈进了一大步。」

AI 和《我的世界》再度携手,这次为什么成了通向 AGI 的里程碑

利用 AI 挑战《我的世界》早已成为 AI 研究领域的热门课题。

作为全球最受欢迎的游戏之一,每月活跃用户超过一亿的《我的世界》,涵盖了几乎各个年龄层的玩家。

早在两三年前,像 OpenAI 等多个模型便已开始尝试挑战这一游戏。

早在 2019 年,研究人员便认为《我的世界》的开放式游戏环境极为适合用于 AI 研究。

例如,一个七岁的小孩在观看 10 分钟的演示后就能学习如何在游戏中找到稀有的钻石,而彼时的 AI 仍然无法做到这一点。

AI 从《我的世界》中的任意位置开始,必须完成指定任务以找到钻石。

那么,DeepMind 这次为什么可以称之为「通向 AGI 的一大步」呢?

这个任务——在游戏内寻找钻石——听起来简单,但实际相当复杂,即便是高手玩家也需要花费 20 至 30 分钟才能找到一颗钻石。

对于不熟悉游戏的朋友来说,这个任务的困难之处在于:

1. 游戏每次生成的场景都是随机的,包括各种地形,如森林、山脉、沙漠和沼泽,这使得 AI 无法仅依赖记忆特定策略来应对;

2. 获取钻石需要经过一系列复杂的前置步骤,而非随意在地图上寻找,例如你需要:

-

首先找到树木

-

接着将树木转化为木材,木材仅用来制作一个工作台

-

有了工作台后,再加上更多的木材才能制作一个木镐

-

然后才能开始挖掘以寻找钻石

-

……

钻石恒久远,AI 不知疲倦

AI 研究者专注于在《我的世界》中寻找钻石,Hafner 表示,因该任务要求一系列复杂步骤,构成了一个漫长的里程碑链条,因而需要深入探索。

以往的 AI 球队收集钻石的方法是依赖人类游戏的视频教学或研究人员的逐步引导。

而 Dreamer 则通过强化学习中的试错法独立探索游戏的全部内容——它识别出能够带来奖励的行为,重复执行这些行为并舍弃其他无效行为。

强化学习是许多重大 AI 进展的基础,但以前的程序大多是专家级的 —— 它们无法从零开始在新领域应用知识。

成功的秘诀在于构建「世界模型」

Dreamer 的成功在于其构建了周围环境的模型,并利用这一世界模型来「预测」未来情境并进行决策。

这种世界模型类似于我们自身的抽象思维,并非对环境的精准复制。

该模型使 Dreamer 能够尝试不同的方法,「世界模型真正赋予了 AI 系统想象未来的能力」,Hafner 说。

这一能力还有助于开发能在现实中学习并互动的机器人 —— 在现实中,试错的成本远比在视频游戏中高得多。

研究团队最初并未专门针对「钻石测试」进行研究,测试 Dreamer 在该挑战中的表现是事后提出的。

Hafner 表示,在构建整个算法过程中并未考虑到这一点,但团队意识到,它提供了测试算法能否快速适应不熟悉任务的良好机会。

在《我的世界》中,团队设计了一种激励方案,每当 Dreamer 完成钻石收集过程中所需的 12 个步骤之一时,就会获得「+1」的奖励——这些步骤包括制作木板与熔炉、开采铁矿和制作铁镐等。

这些中间奖励促使 Dreamer 选择更可能获得钻石的行动。团队每 30 分钟就重置一次游戏,避免 Dreamer 习惯某种特定情境,而是让其学习获得更多奖励的一般原则。

在这种设置下,Dreamer 需连续大约九天才能找到至少一颗钻石。

而玩家高手寻找一颗钻石需要 20 至 30 分钟,新手则需要更长时间。

在 Minecraft 中挑战钻石的艰辛

游戏中每次冒险都发生在一个独特且无限随机生成的三维世界里。

每次游戏持续时间到 30 分钟,或直到玩家死亡,游戏根据 MineRL 竞赛提供的动作构成了一个分类动作空间,包含了各种制作动作。

DeepMind 表示,Dreamer 是第一个在没有人类数据帮助的情况下,从零开始在《我的世界》中成功收集钻石的算法。

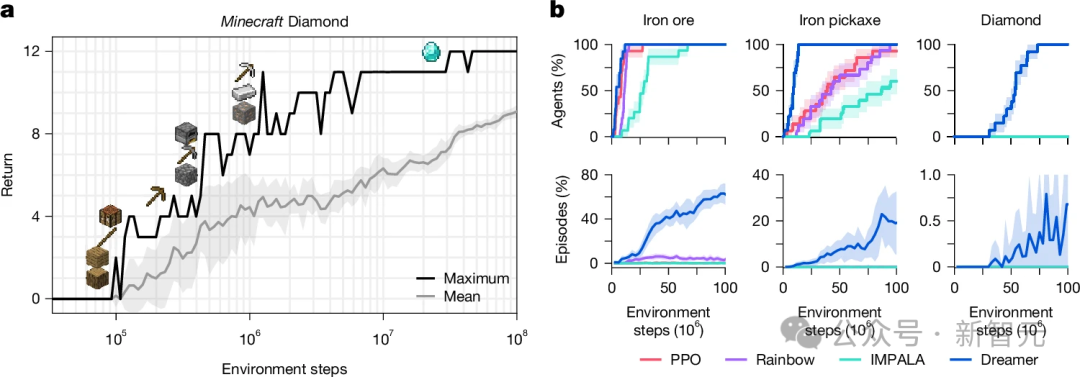

所有 Dreamer 智能体在一亿次步骤内都发现了钻石。所有物品的成功率显示于图右的扩展数据中。

尽管其他一些强大的算法(如 PPO、Rainbow 和 IMPALA)在高级物品(如铁镐)方面有所进展,但无一能成功找到钻石。

Dreamer 算法的核心原理

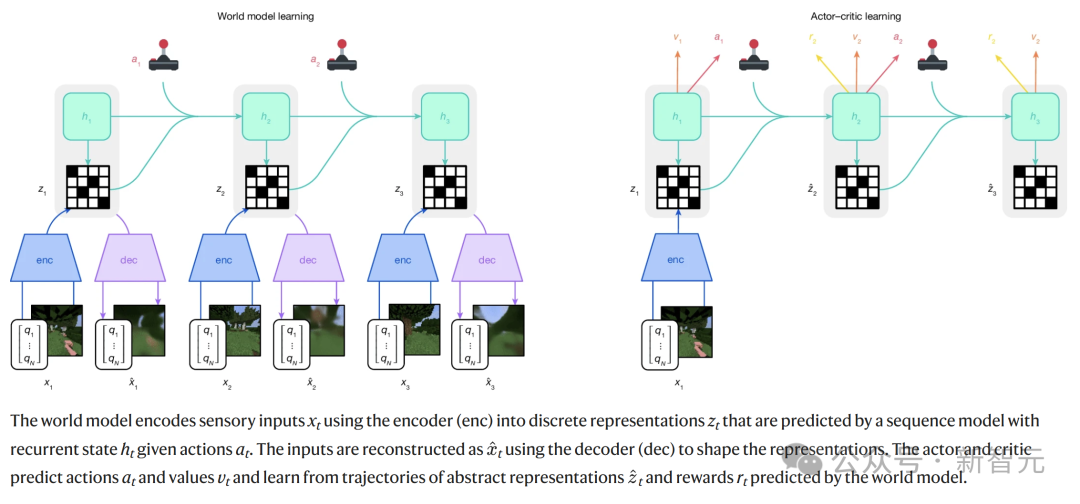

Dreamer 算法的核心在于学习一个世界模型。

这就像是智能体的大脑,使得智能体能够获得丰富的感知能力,并通过想象未来场景来规划其行为。

算法由三个关键神经网络组成:世界模型、评论者网络和行动者网络。

世界模型通过自动编码学习感官输入的表示,并通过预测潜在动作的未来结果和奖励来支持规划。

世界模型被构建为递归状态空间模型,如图所示。

评论者网络对世界模型预测的每一结果进行价值评估,判断其对实现目标的帮助程度。

行动者网络则根据评论者的反馈选择能实现最佳结果的行动。

这三个网络相辅相成,伴随智能体与环境的互动,通过重放经验共同训练。

在训练过程中,世界模型的学习至关重要。它需从感官输入中提取有用信息,并预测未来状态与奖励。

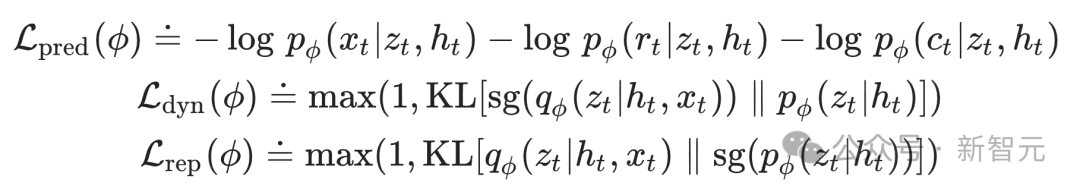

为实现这一目标,世界模型需最大化预测损失、动态损失及表示损失。

预测损失用于训练解码器和奖励预测器,动态损失训练序列模型以预测下一个表示,而表示损失则使表示具有更高的可预测性。

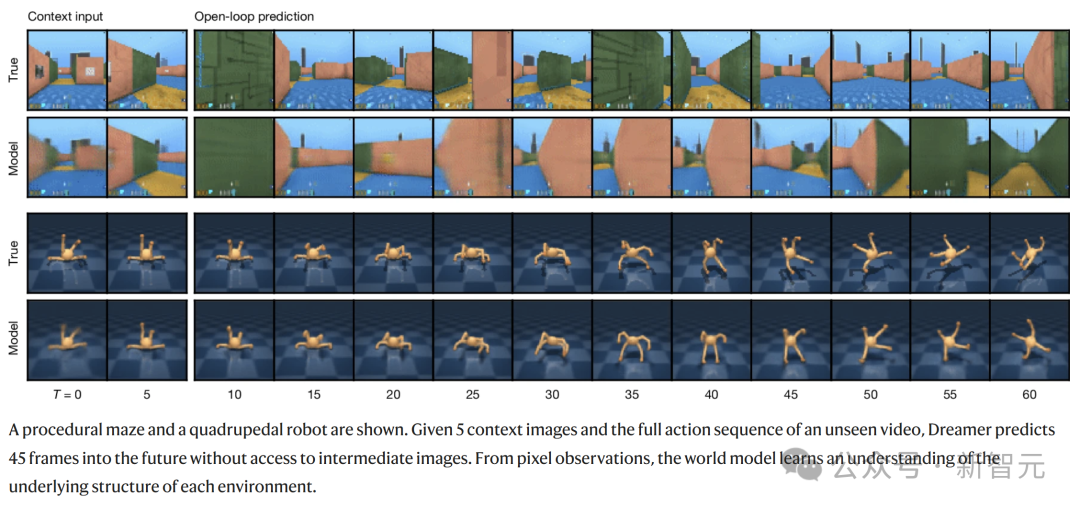

图中展示了世界模型的长期视频预测。

实验结果

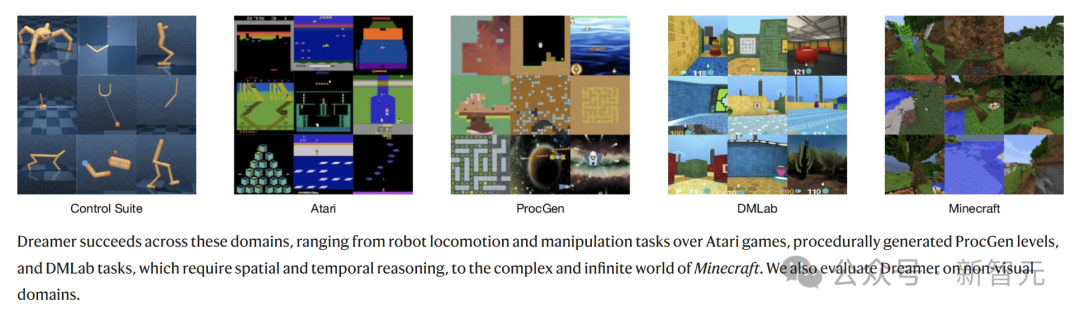

DeepMind 团队在 8 个领域的 150 多个任务中评估了 Dreamer 算法的通用性,包括连续与离散动作、视觉与低维输入、密集与稀疏奖励、不同奖励尺度以及二维与三维世界等各种场景。

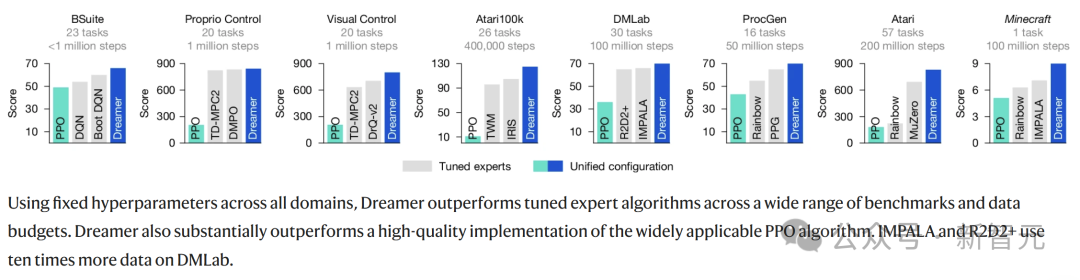

图中展示了基准测试结果,Dreamer 在所有测试中均表现优于其他方法。

-

在 Atari 基准测试中,它能在使用少量计算资源的情况下,超越 MuZero 算法,并优于 Rainbow 和 IQN 算法。

-

在 ProcGen 基准测试中,在面对随机生成的关卡和视觉干扰时,Dreamer 算法在 5000 万帧的预算内超越了经过调整的 PPG 和 Rainbow 算法。

-

在 DMLab 基准测试中,经过 1 亿帧的训练后,其表现超过了 IMPALA 和 R2D2 + 智能体,数据效率显著提高。

-

在 Atari100k 基准测试中,尽管训练预算仅为 40 万帧,Dreamer 算法依然超越其他方法。

-

在 BSuite 基准测试中,它表现优异,在规模稳健性方面有显著提高。

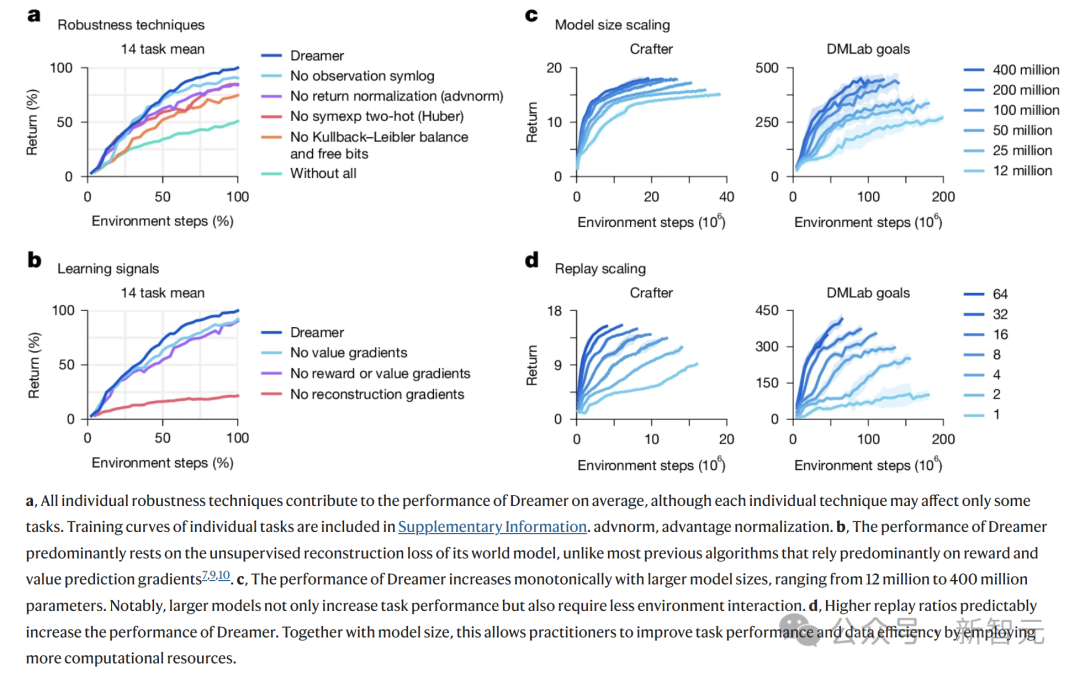

研究人员进行了消融实验,结果显示,所有的稳健性技术均对算法性能提升起到了正面作用。

研究人员还考察了 Dreamer 算法的扩展性。

通过训练不同规模的模型,参数从 12M 到 4M,他们发现,扩大模型规模不仅能提高任务表现,同时也能减少所需数据。

更多的梯度步数也减少了学习成功行为所需的交互次数,表明 Dreamer 算法在计算资源增加时,能够稳定提高性能,从而为实用应用提供了更灵活的选择。

这篇论文致力于训练一个单一算法,希望其能够在多样化的强化学习任务中取得优异表现。

在《我的世界》中寻找钻石或许只是通向 AGI 之路的第一步。

AI 的下一个壮举是《我的世界》玩家所面临的终极挑战:击败末影龙,这个虚拟世界中最为恐怖的生物。

参考资料:

-

https://www.nature.com/articles/d41586-025-01019-w#ref-CR1

-

https://www.nature.com/articles/s41586-025-08744-2

-

https://x.com/danijarh/status/1907511182598222095

本文来源于微信公众号:新智元(ID:AI_era),原标题《DeepMind 闭关修炼「我的世界」,自学成才挖钻登 Nature!人类玩家瑟瑟发抖》