百度端到端语音语言大模型发布,成本宣称最高降 90%

GoodNav 3 月 31 日报道,

在今日的百度 AI DAY 上,百度首次推出了一款基于全新互相关注意力(Cross-Attention)的端到端语音语言大模型,并宣称实现了超低时延和超低成本,在电话语音频道的语音问答场景中,调用成本较行业平均水平降低约 50%-90%。

当天,文小言宣布进行品牌重塑,并率先接入该模型,同时推出了多模型融合调度、图像问答等功能升级。在接入该模型后,文小言不仅能提供更真实的语音聊天效果,还支持重庆、广西、河南、广东、山东等地方方言。根据介绍,这款语音大模型具备极低的训练和使用成本以及极快的推理响应速度,能够将用户等待的时间从行业普遍的 3-5 秒缩短至约 1 秒。

更新后的文小言还添加了“多模型融合调度”功能,整合了百度自主研发的文心 X1、文心 4.5 等模型,并接入了 DeepSeek-R1 等高品质第三方模型,实现了多模型之间的智能协作。用户可以选择“自动模式”,一键调用最佳模型组合,也可以根据需要选择单一模型来完成特定任务,从而提升响应速度和任务处理能力。

从活动中了解到,文小言还增强了图片问答功能,用户可以通过拍摄或上传图片并以文字或语音提问,直接获得深度解析。例如,拍摄一道数学题可以实时生成解题思路和视频解析;上传多款商品的图片可以比较参数和价格,帮助购物决策。

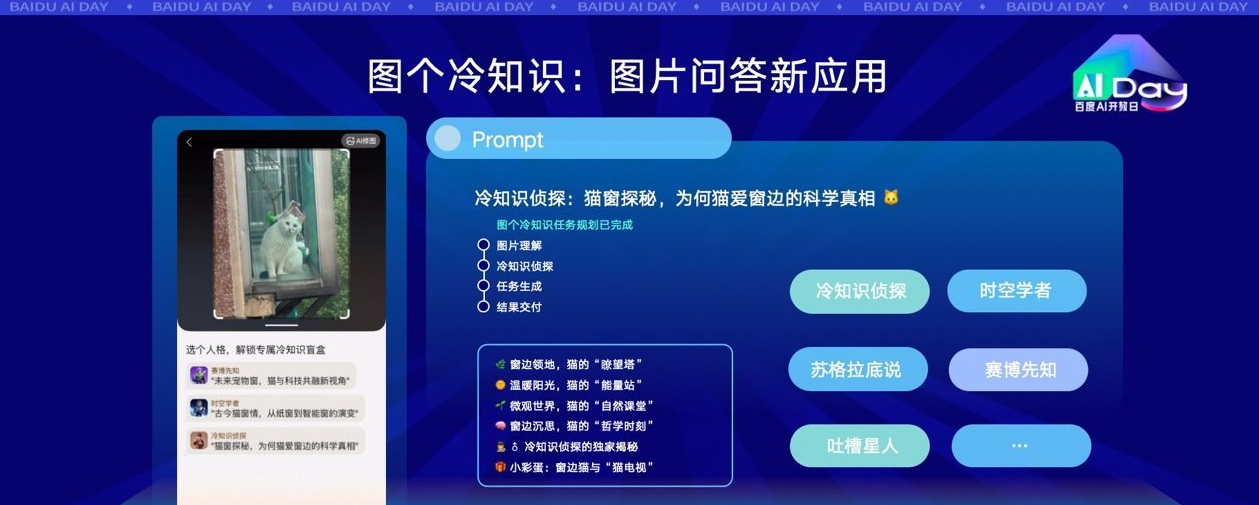

此外,文小言新增了“图个冷知识”功能,用户可以预设“历史学者”“科技达人”等人设视角,为同一张图片赋予多维解读。例如,当用户询问“猫窗探秘,为何猫爱窗边的科学真相?”时,文小言可以从狩猎本能、能量获取、领地意识等多重角度给予独特的解答。

百度语音首席架构师贾磊表示,该模型是业内首个推出的基于全新互相关注意力 (Cross-Attention) 的端到端语音语言大模型。“在满足特定交互指标的语音场景下,该模型的调用成本较行业平均降低了 50%-90%,推理响应速度非常快,将语音交互的等待时间压缩到约 1 秒,极大改善了交互的流畅性。同时,在大模型的支持下,实现了流式逐字的 LLM 驱动的多情感语音合成,情感表现丰富、真实且拟人化,交互听感得到了显著提升。”