开源逆袭:TAO 方法微调 Llama 模型,FinanceBench 跑分超 GPT-4o

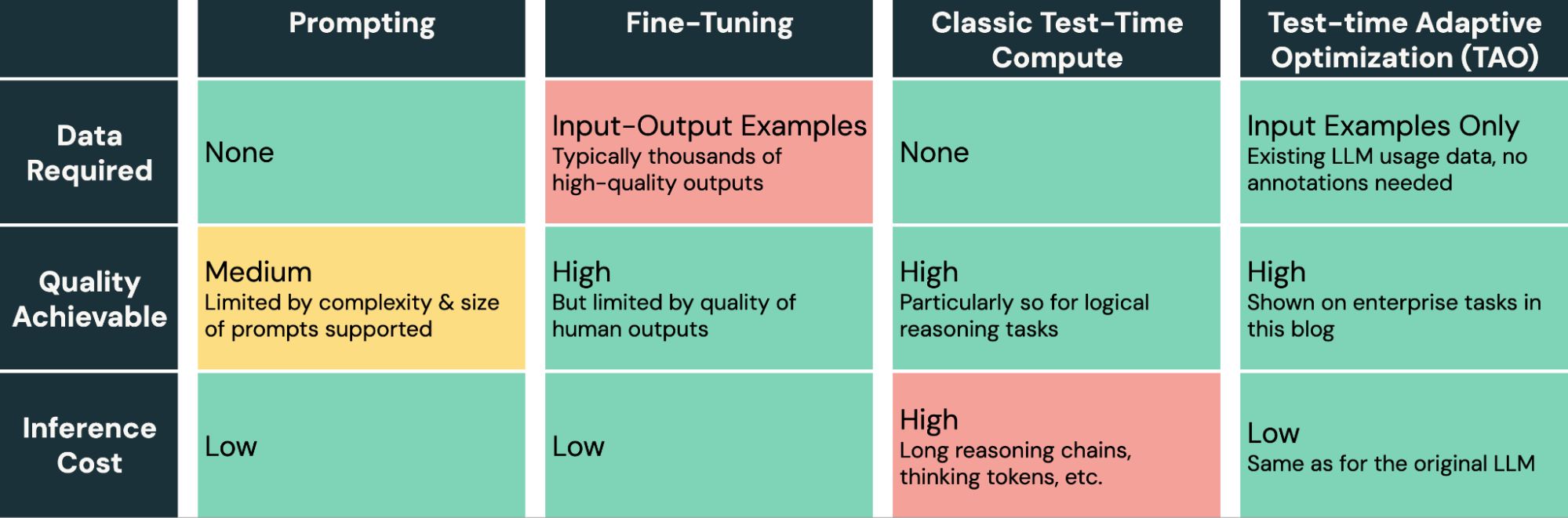

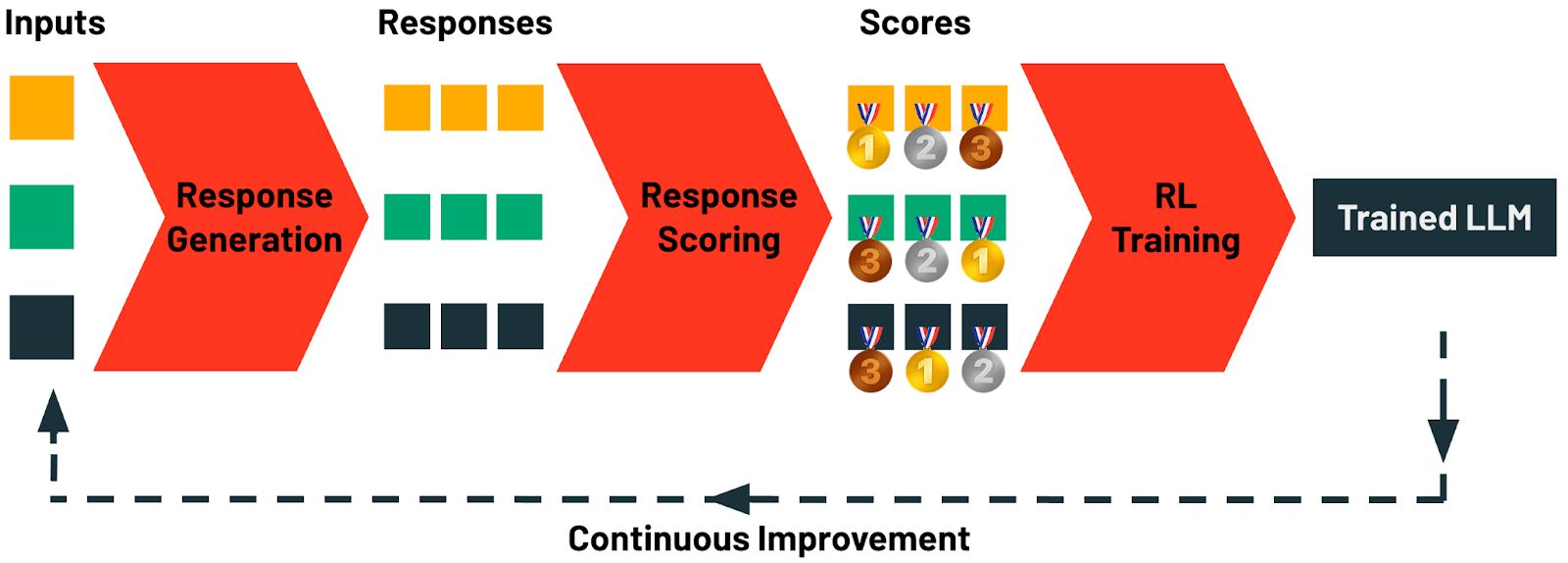

GoodNav 3 月 27 日消息,科技媒体 NeoWin 于昨日(3 月 26 日)发表了一篇文章,指出数据智能公司 Databricks 推出了新型大语言模型微调方法 TAO(Test-time Adaptive Optimization)。该方法利用无标注数据和强化学习技术,在大幅降低企业成本的同时提升模型性能。

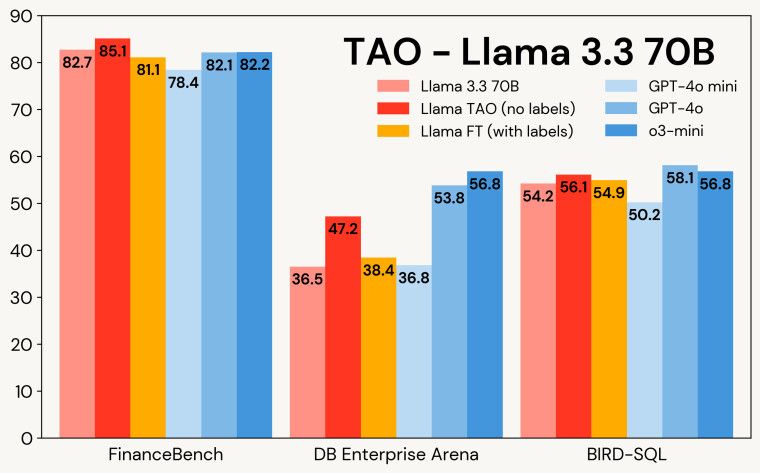

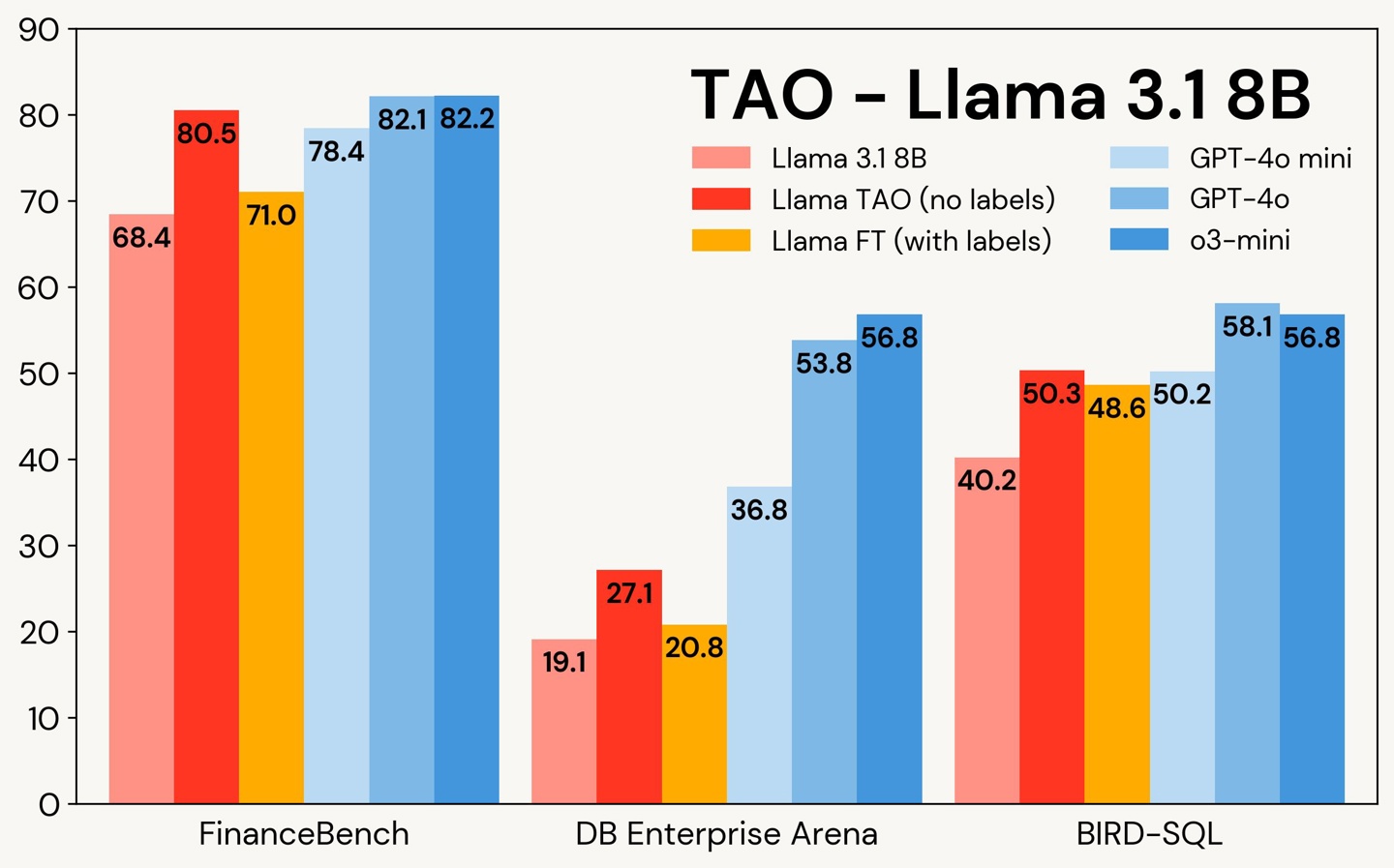

测试表明,在金融文档问答和 SQL 生成任务中,经过 TAO 微调的 Llama 3.3 70B 模型的表现超过了传统的标注微调方法,接近 OpenAI 的顶级闭源模型。

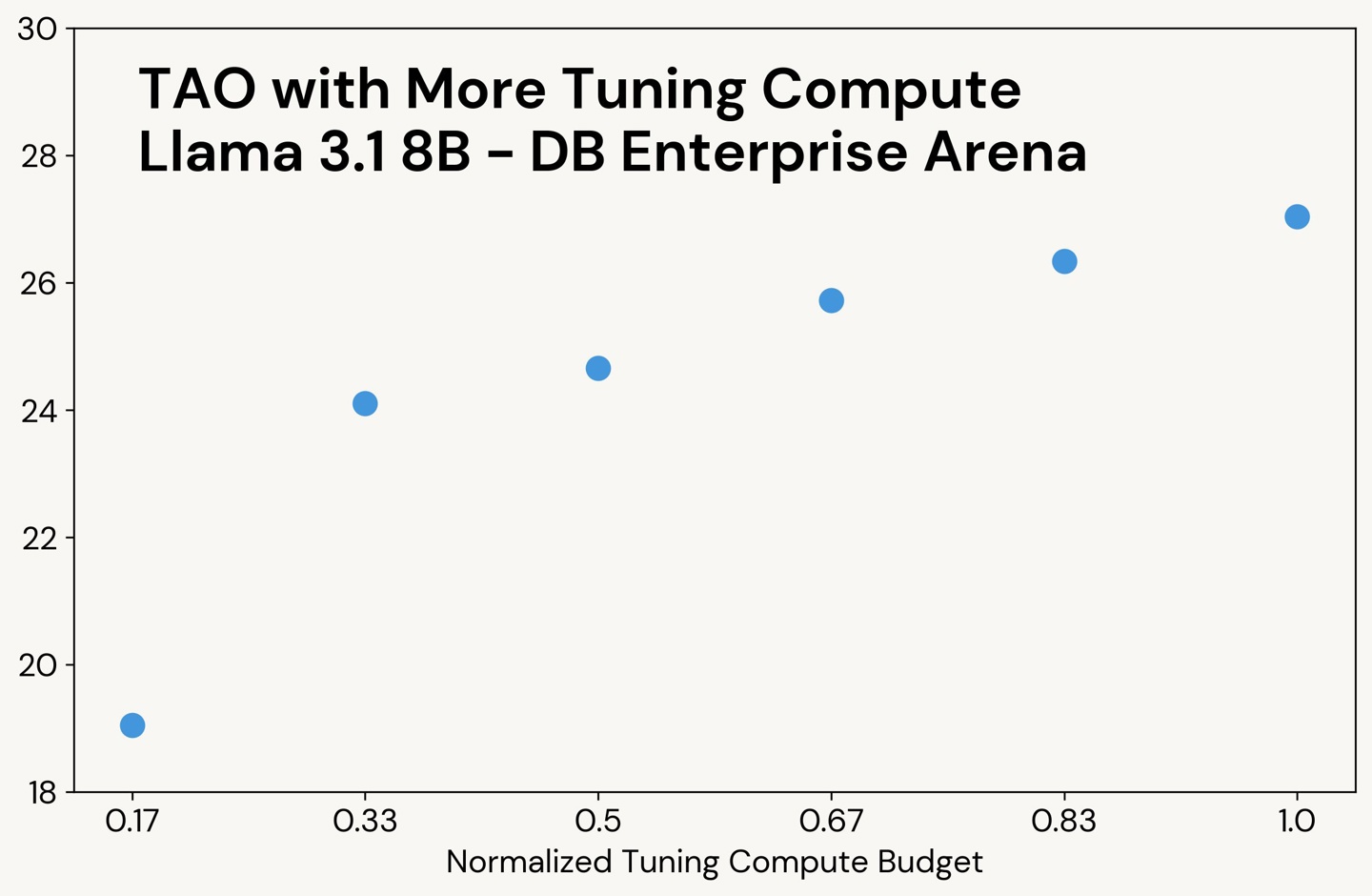

TAO 方法通过测试时计算(test-time compute)自动探索任务的可能性,并结合强化学习来优化模型,从而消除了人工标注的成本。在三个主要企业基准测试中,TAO 微调的 Llama 模型表现出色:

-

FinanceBench(7200 道 SEC 文档问答):TAO 模型得分为 85.1,优于标注微调(81.1)和 OpenAI o3-mini(82.2)。

-

BIRD-SQL:TAO 模型得分 56.1,接近 GPT-4o(58.1),远超标注微调(54.9)。

-

DB Enterprise Arena:TAO 模型得分 47.2,而 GPT-4o 模型的得分为 53.8。

TAO 技术为开源模型提供了持续的进化途径:用户使用越频繁,模型利用反馈数据自我优化的潜力也越大。该技术目前已在 Llama 模型上启动了内部测试,企业可以通过申请表单参与。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...