全新 ARC-AGI-2 测试登场:AI 模型得分惨淡,被人类碾压

GoodNav 3 月 25 日报道,Arc Prize 基金会是一家由著名人工智能研究者弗朗索瓦・肖莱(François Chollet)共同创办的非营利机构。该基金会于本周一在其博客上发布了名为 ARC-AGI-2 的新测试,目的是评估顶级人工智能模型的通用智能水平。这项测试的难度极高,目前为止,大多数 AI 模型在该测试中均表现不佳。

根据 Arc Prize 排行榜的数据显示,以推理能力著称的 AI 模型,例如 OpenAI 的 o1-pro 和 DeepSeek 的 R1,在 ARC-AGI-2 测试中的分数仅介于 1% 到 1.3%。而包括强大的非推理型模型如 GPT-4.5、Claude 3.7 Sonnet 和 Gemini 2.0 Flash 在内的模型,得分也仅约为 1% 左右。

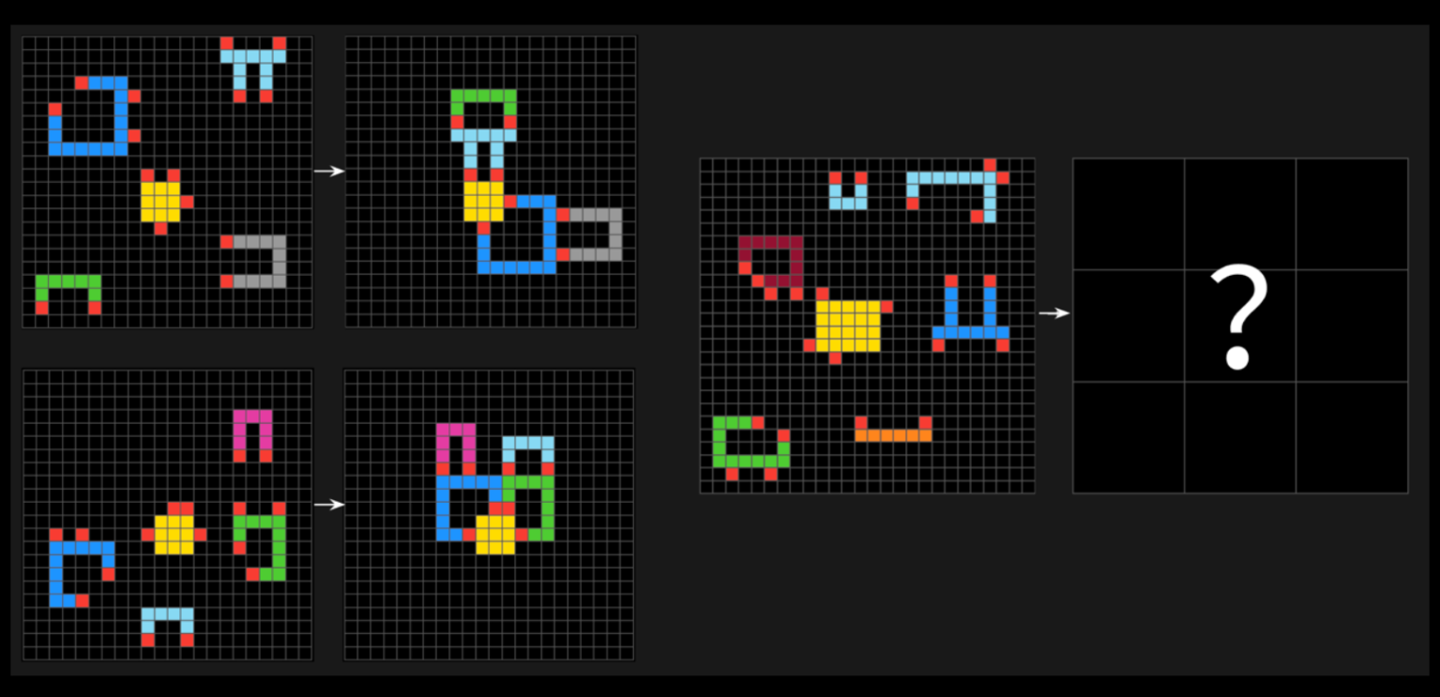

ARC-AGI 测试由一系列类似谜题的问题组成,要求 AI 从一组不同颜色的方块中识别出视觉模式,并生成正确的“答案网格”。这些题目的设计旨在促使 AI 应对此前未见过的新问题。为了建立人类的基准,Arc Prize 基金会邀请了400多名参与者参加 ARC-AGI-2 测试。平均而言,这些参与者组成的“团队”能正确回答测试中 60% 的问题,这一表现明显超过任何 AI 模型的得分。

在 X 平台上,肖莱表示,ARC-AGI-2 测试比之前的 ARC-AGI-1 测试能够更准确地评估 AI 模型的实际智能水平。Arc Prize 基金会的测试旨在验证 AI 系统是否能在训练数据之外高效学习新技能。

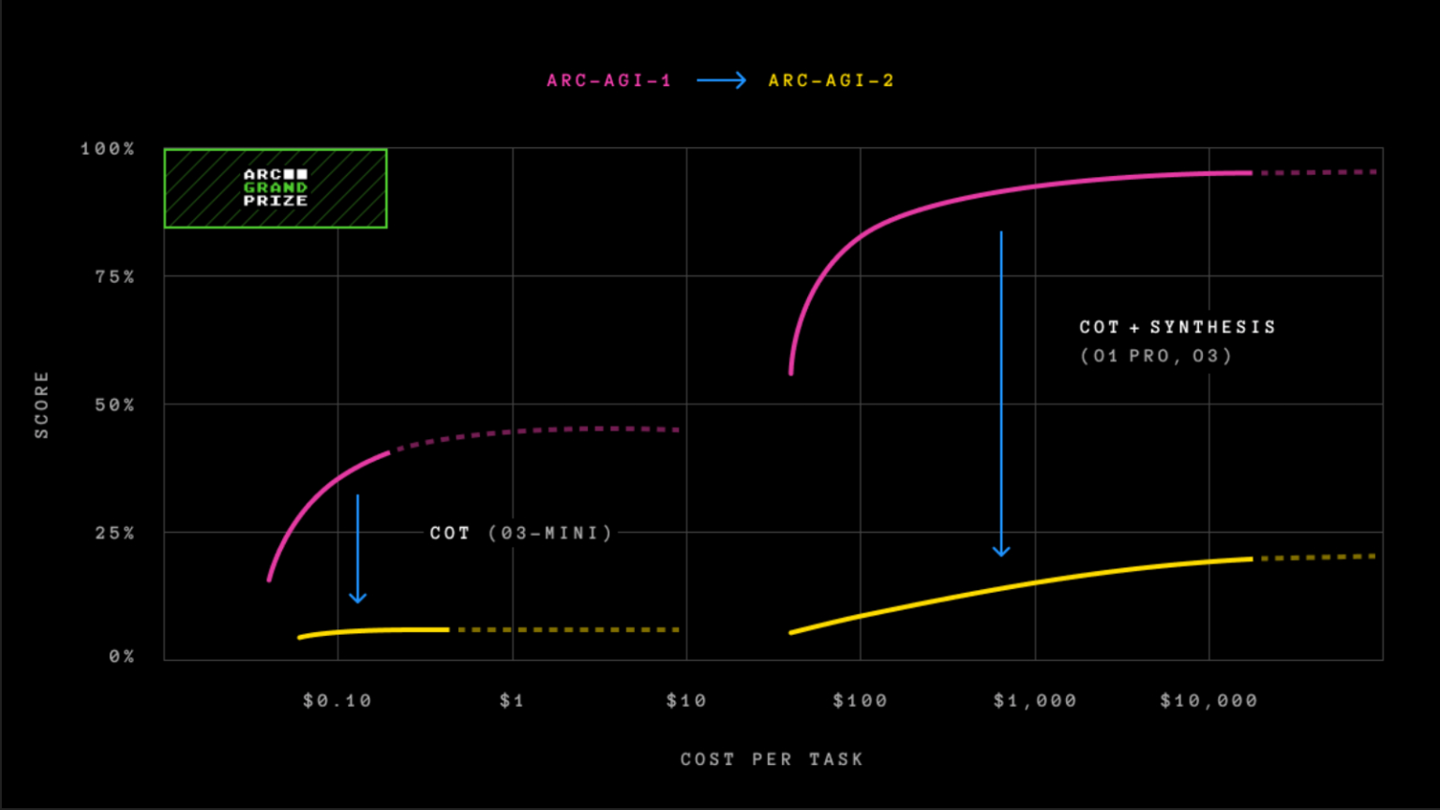

肖莱强调,与 ARC-AGI-1 不同,新版 ARC-AGI-2 测试禁止 AI 模型依赖于“蛮力”——即大量计算能力——来找到解决方案。他曾承认,这是 ARC-AGI-1 的主要不足之处。为此,ARC-AGI-2 引入了一项新指标:效率。它还要求模型实时识别模式,而不是仅依赖记忆。

“智能不仅仅是解决问题或获得高分的能力,”Arc Prize 基金会的联合创始人格雷格・卡姆拉德(Greg Kamradt)在博客中写道,“获取和进行这些能力的效率是决定性的关键因素。我们提出的问题不仅是‘AI 能否获得解决任务的技能?’,还有‘以何种效率或代价?’”

ARC-AGI-1 在约五年的时间里无人可敌,直到 2024 年 12 月,OpenAI 发布了其先进的推理模型 o3,该模型超越了所有其他 AI 模型,并在评估中达到了人类水平的表现。然而,正如当时指出的,o3 在 ARC-AGI-1 的优异表现是以昂贵的成本为代价的。

OpenAI 的 o3 模型(低配版)—— 首个在 ARC-AGI-1 中取得突破的版本,在该测试中得分高达 75.7%,但在 ARC-AGI-2 测试中,即使使用价值 200 美元的计算能力,其得分仍然只有 4%。

ARC-AGI-2 的推出恰逢科技行业人士呼吁建立新的、未饱和的基准,以衡量 AI 的进步。Hugging Face 的联合创始人托马斯・沃尔夫(Thomas Wolf)最近在接受 TechCrunch 采访时提到,AI 行业缺乏足够的测试来评估所谓的通用人工智能的关键特质,包括创造力。

与此同时,Arc Prize 基金会还宣布了 2025 年的 Arc Prize 竞赛,挑战开发者在 ARC-AGI-2 测试中达到 85% 的准确率,同时确保每项任务的成本不超过 0.42 美元(注:现汇率约合人民币 3 元)。