Meta 推出强化学习新框架 SWEET-RL,让 AI 更懂人类意图

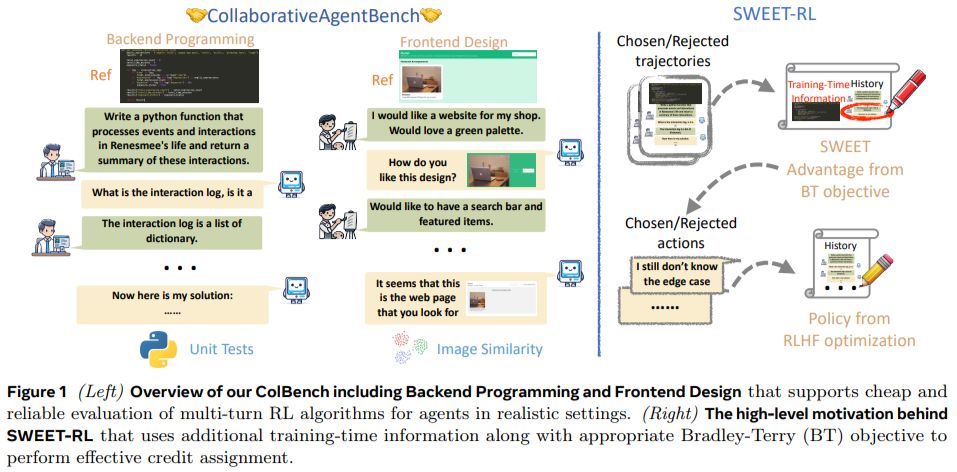

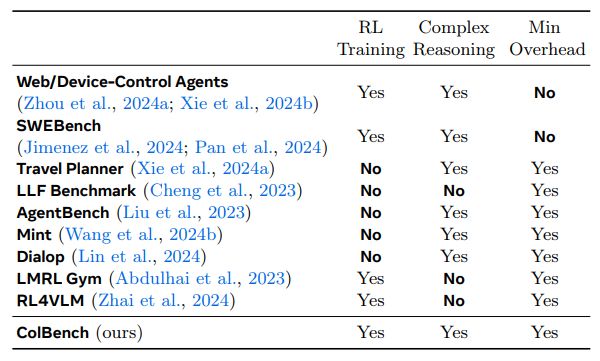

GoodNav 3 月 24 日报道称,科技媒体 marktechpost 于昨日(3 月 23 日)发表了一篇博文,指出 Meta AI 公司与加州大学伯克利分校合作,共同推出了一个名为 SWEET-RL 的强化学习框架,并发布了 CollaborativeAgentBench(ColBench)基准测试。

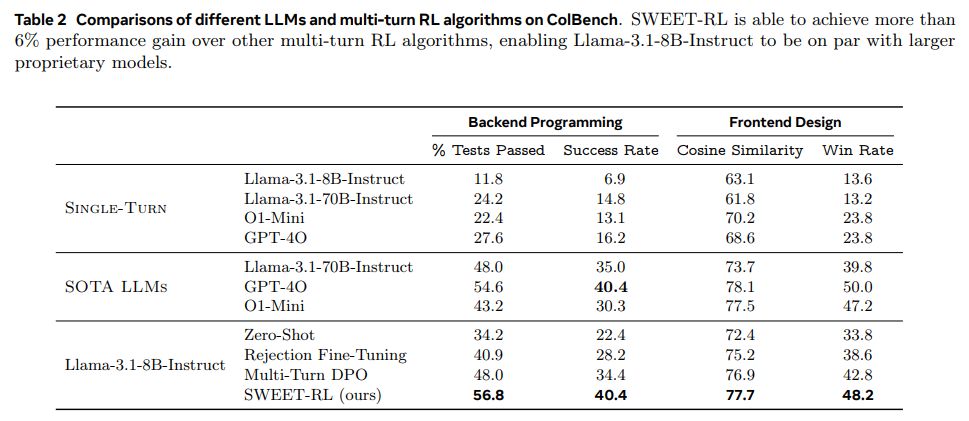

这项创新旨在提升大语言模型(LLMs)在多轮人机协作任务中的表现,尤其是在后端编程和前端设计领域。SWEET-RL 通过逐步优化决策,显著提升了模型的任务完成率,展示了在开源模型(如 Llama-3.1-8B)和专有模型(如 GPT-4o)之间的竞争潜力。

项目背景

据博文介绍,大语言模型正在不断演变为能够处理复杂任务的自主智能体,但在多轮决策任务中仍面临诸多挑战。

传统的训练方法通常依赖于单轮反馈或仅模仿高概率的行为,这使得长期依赖和累积目标的处理变得无效。这导致模型在理解人类意图和进行多步骤推理时的表现欠佳,特别是在协作场景中。

SWEET-RL 的创新之处

SWEET-RL 采用了一种非对称的“演员-评论家”架构,评论家在训练过程中可以使用额外的信息(如正确答案),从而能够更准确地评估演员的决策。

该框架直接针对逐步的优势函数建模,简化了信用分配过程,并且与大语言模型的预训练架构更好地契合。实验结果显示,SWEET-RL 在后端编程任务中的通过率提高至 48.0%,而前端设计任务的余弦相似度达到了 76.9%,明显优于其他多轮强化学习方法。

ColBench 基准测试

ColBench 拥有超过 10000 个训练任务和 1000 个测试案例,模拟了真实的人机协作场景。这些任务的设计涵盖后端编程(例如 Python 函数编写)和前端设计(例如 HTML 代码生成),并限制每轮交互最多为 10 次。

该基准测试通过单元测试的通过率(代码)和余弦相似度(设计)来评估模型的表现,为多轮任务提供了可靠的标准。