AMD 推出开源项目“GAIA”实现本地大模型高效运行:针对锐龙 AI 300 系列处理器优化,目前仅适用于 Windows

GoodNav 3 月 22 日报道,当地时间周四,AMD 宣布发布了一款名为 GAIA(发音为/ˈɡaɪ.ə/)的应用,该应用专为本地运行大型语言模型(LLM)而设计,并已在 Github 上开源,目前仅支持 Windows 平台。

GAIA 是一款生成式 AI 应用,具备在 Windows PC 上本地化私密运行 LLM 的能力,并针对锐龙 AI 300 系列处理器进行了特别优化,这标志着 AMD 在边缘计算领域的又一重要进展。

在 NPU 上运行 GAIA 可以提升特定 AI 任务的性能。从 Ryzen AI 软件版本 1.3 开始,能够混合部署 NPU 和核显以支持量化 LLM。

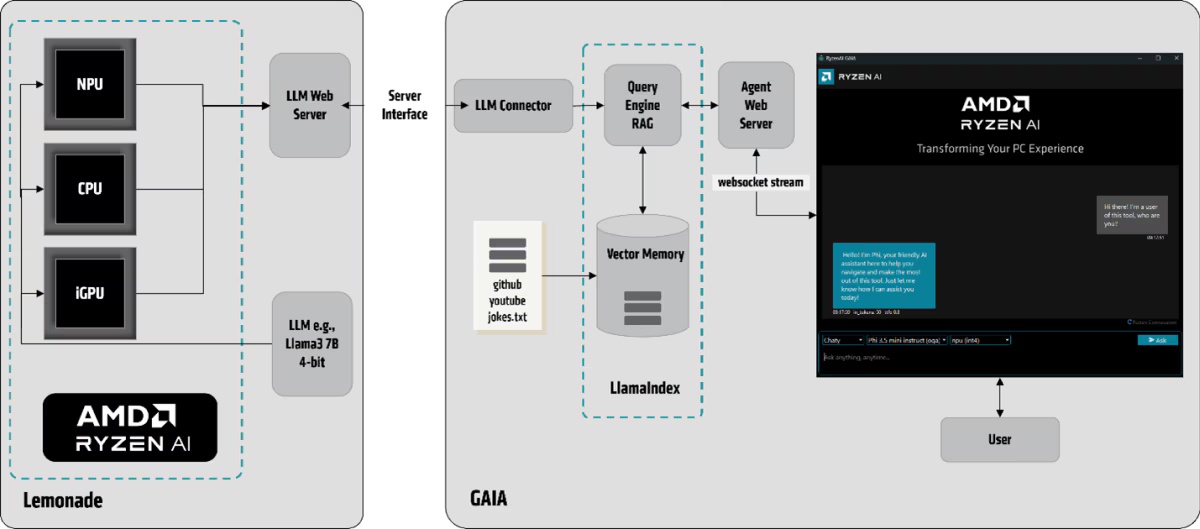

GAIA 的核心组件基于 ONNX TurnkeyML 的 Lemonade SDK 开发,采用检索增强生成(RAG)技术框架,能够通过本地向量索引实时检索和分析 YouTube、GitHub 等外部数据。

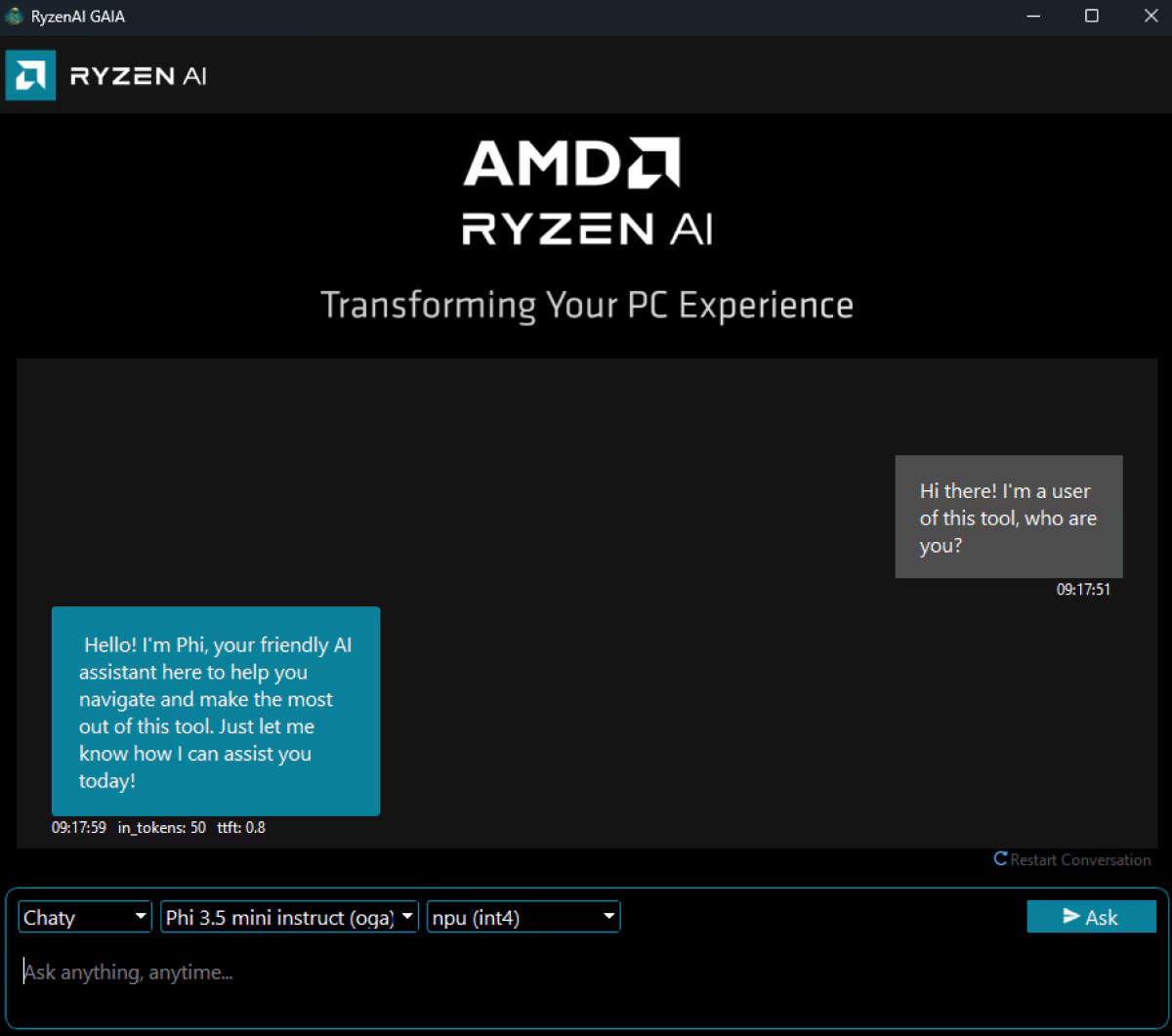

系统工作流由 LLM 连接器、LlamaIndex RAG 管道和代理 Web 服务器三个主要模块组成,支持 Llama、Phi 等主流模型。功能模块分为四个 AI 智能体:

-

Chaty:支持历史对话的聊天机器人

-

Clip:YouTube 视频搜索和问答工具

-

Joker:具幽默风格的笑话生成器

-

Simple Prompt:模型直接交互测试工具

在硬件方面,AMD 提供标准版和混合版两种安装方案。标准安装包兼容任何 Windows PC(包括非 AMD 硬件),通过 Ollama 后端实现跨平台支持。

混合安装包专为搭载锐龙 AI 300 系列处理器的设备优化,能够智能分配 NPU 和集成显卡的计算任务。AMD 表示,Ryzen AI 软件自 1.3 版本开始支持量化模型在 NPU 和集成显卡之间的混合部署。

在隐私与性能方面的优势包括:

-

本地处理确保医疗、金融等敏感行业数据不外泄

-

响应延迟降低至毫秒级,较云端方案缩短 40-60%

-

NPU 专用架构实现每瓦性能提升,支持离线运行环境

该项目采用 MIT 开源协议,代码库已在 GitHub 开放。AMD 特别欢迎开发者为定制代理模块贡献代码,目前已有多个行业定制化代理在开发之中。

此外,尽管 GAIA 目前不支持 Linux / macOS 系统,但 AMD 官方文档透露未来可能会扩展到更多平台支持。

附 Github 地址:

https://github.com/amd/gaia