感谢 DeepSeek:Predibase 发布全球首个端到端强化微调平台并开源,支持无服务器和端到端训练方法

GoodNav 3 月 20 日消息,昨晚,大模型训练和开发平台 Predibase 正式发布了其首个端到端强化微调平台(RFT)。

Predibase 表示,DeepSeek-R1 的开源在全球人工智能领域引起了广泛关注,使得许多人认识到强化学习微调在大模型训练中的重要性。受到这一点的启发,他们设计了这个无服务器的端到端强化微调平台。

与传统的监督式微调方式相比,RFT 不依赖于大量的标注数据,而是通过奖励与自定义函数来实现持续的强化学习。同时,平台支持无服务器及端到端训练流程,用户可以在同一平台完成数据管理、模型训练及应用部署。只需一个浏览器,设置微调目标、上传数据,用户便可轻松完成以前复杂的大模型微调流程。

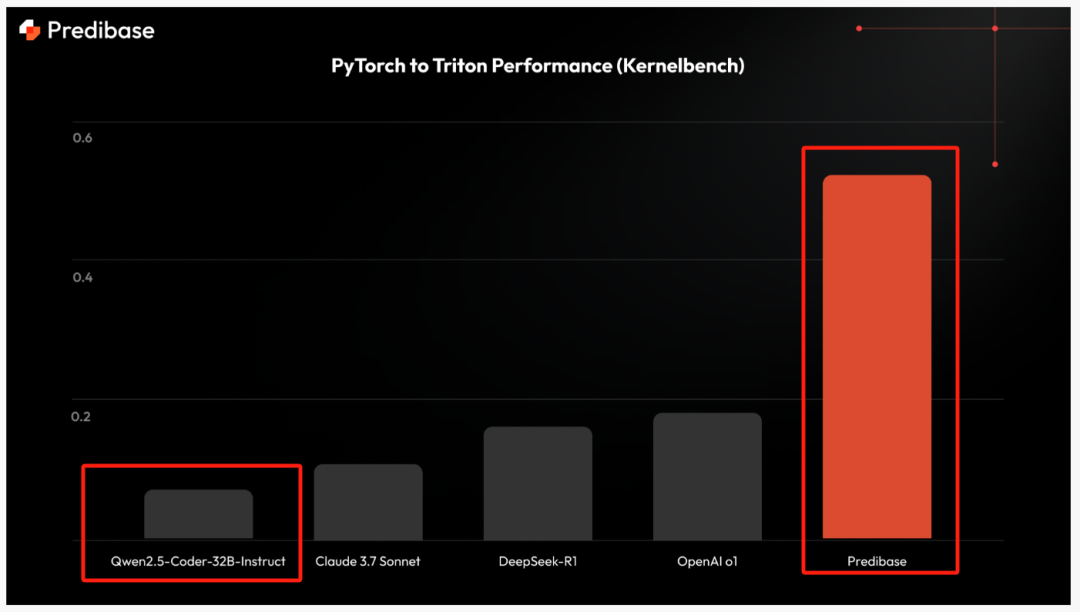

为了展示 RFT 的强大优势,Predibase 基于阿里开源的 Qwen2.5-Coder-32B-instruct,微调出了一款专门用于将 PyTorch 代码转换为 Triton 的模型 Predibase-T2T-32B-RFT。

Predibase-T2T-32B-RFT 通过 RFT 以交互方式优化模型行为,使用极少的标记数据来提升下游任务的质量,因此它成为了专有大语言模型的高性价比、高性能替代选项。

借助 RFT,Predibase 在训练过程中融合了冷启动监督式微调、强化学习和课程学习的策略,且只用到了十几个标注数据点。

在 Kernelbench 数据集上进行的基准测试显示,经过强化的 Qwen2.5-Coder-32B-instruct 的准确率比 DeepSeek-R1 和 OpenAI 的 o1 高出 3 倍,比 Claude 3.7 Sonnet 高出四倍以上,而模型的规模相比这三者要小得多。

附开源地址:

https://huggingface.co/predibase/Predibase-T2T-32B-RFT

在线体验地址:

https://predibase.com/reinforcement-fine-tuning-playground