Meta 开源小语言 AI 模型 MobileLLM 家族:适用智能手机、提供 125M-1B 版本

GoodNav 11 月 8 日消息,Meta 上周发布了一份新闻稿,宣布正式开源针对智能手机设计的小型语言模型 MobileLLM 家族,并为该系列模型新增了600M、1B 和 1.5B 三个不同规模的参数版本,同时附上了项目的 GitHub 页面(点此访问)。

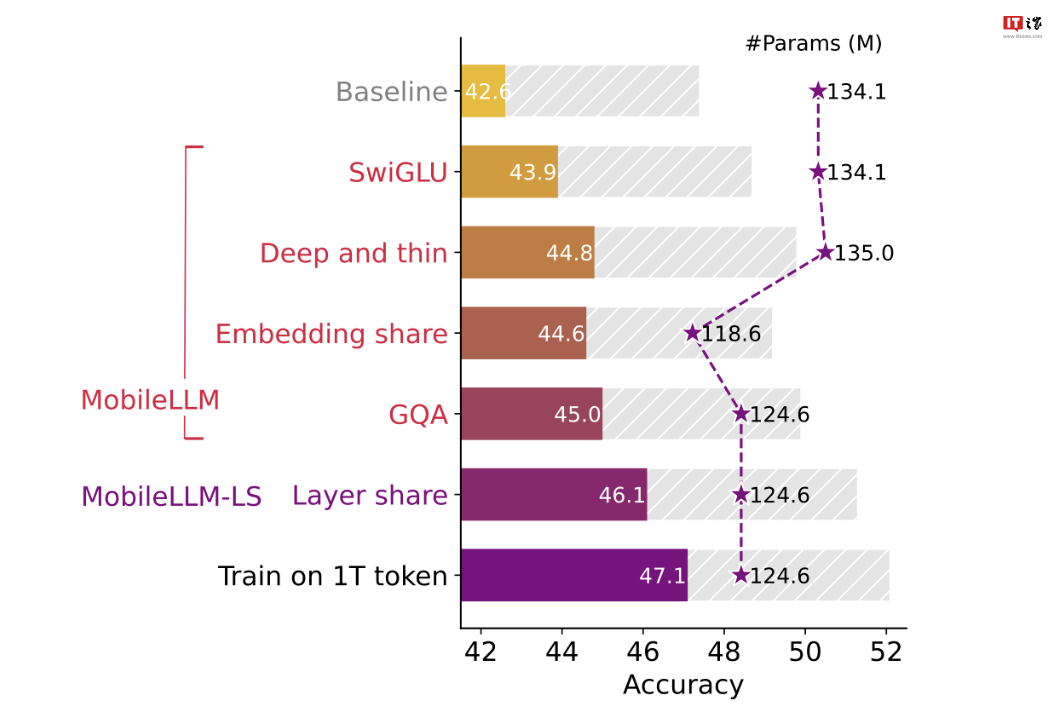

Meta 的研究人员表示,MobileLLM 模型家族是专门为智能手机开发的,声称采用了优化的架构,并引入了“SwiGLU 激活函数”和“分组查询注意力(grouped-query attention)”机制,从而在效率与性能之间实现了良好的平衡。

此外,MobileLLM 模型的训练速度也相对较快。Meta 研究人员指出,在配备 32 颗 Nvidia A100 80G GPU 的服务器环境下,使用 1 万亿词(tokens)对不同参数量的 MobileLLM 模型进行训练时,1.5B 版本仅需 18 天,而 125M 版本则只需 3 天。

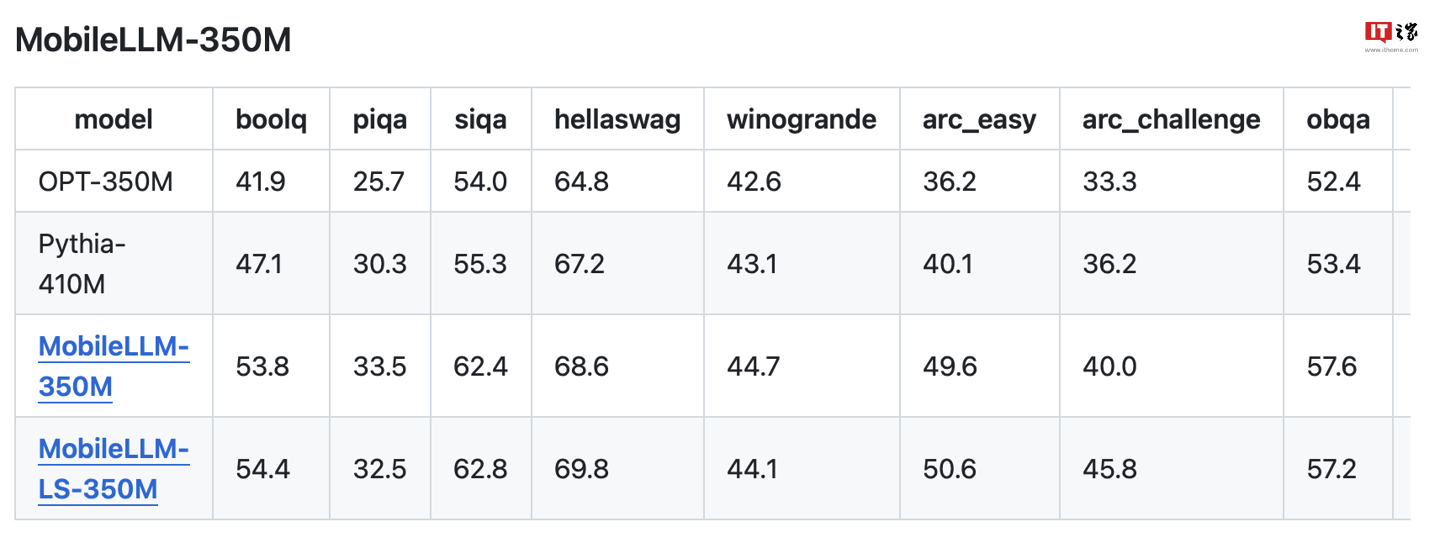

从测试结果来看,MobileLLM 的 125M 和 350M 模型在零样本常识理解任务中的准确率比 Cerebras、OPT、BLOOM 等当前最先进模型(SOTA)分别高出 2.7% 和 4.3%。

Meta 的研究人员还将 MobileLLM-1.5B 与其他更大参数量的模型进行了对比,测试结果显示其在指标上领先 GPT-neo-2.7B、OPT-2.7B、BLOOM-3B 及 Qwen 1.5-1.8B 等模型。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...