英伟达团队机器训练新方法:仅 5 次演示让机器生成 1000 个新 demo

经过五次示范,机器人能够学习到一项复杂的技能。

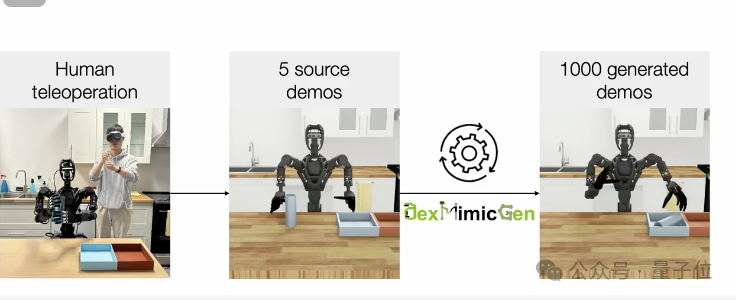

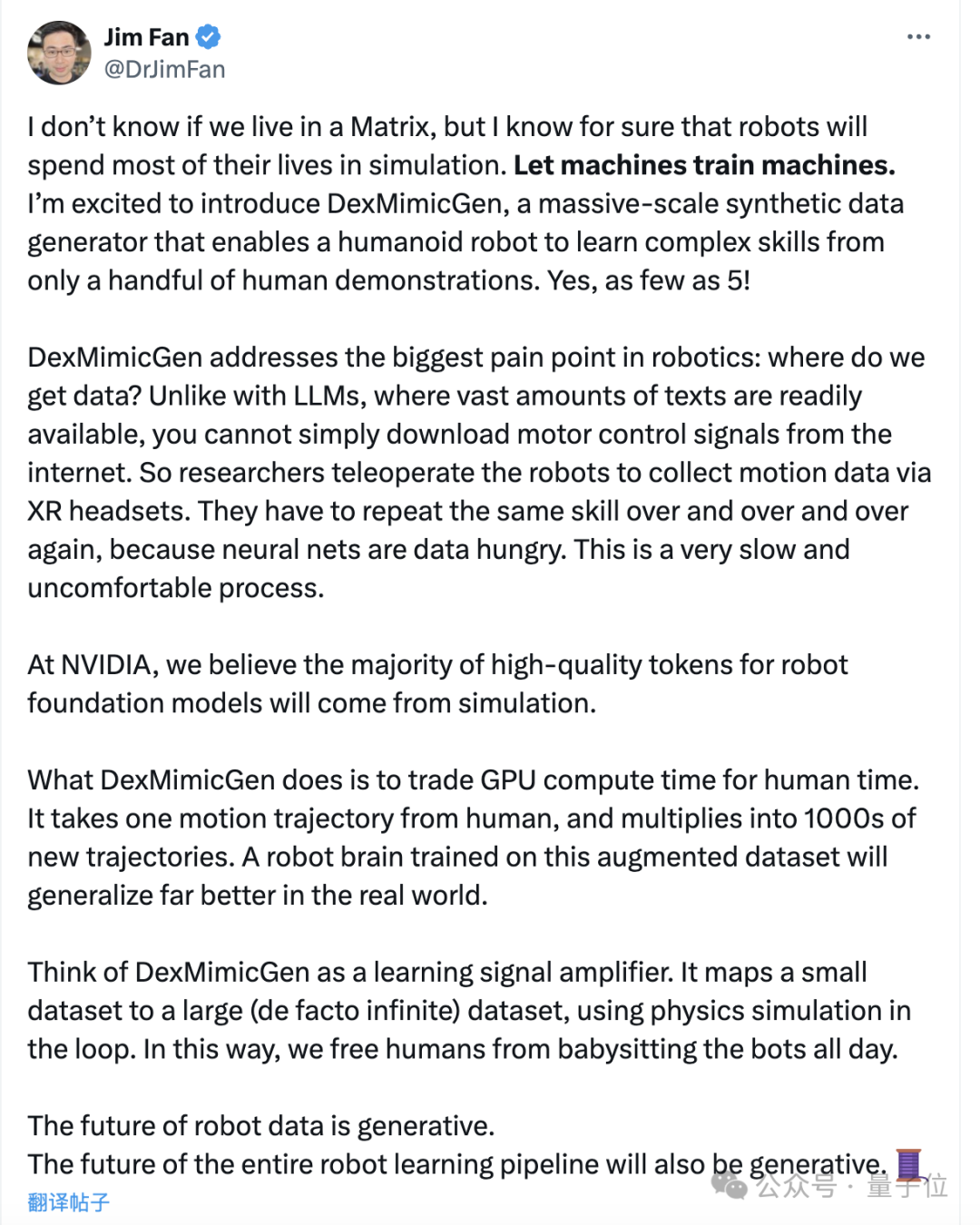

英伟达实验室提出了一种新方法来解决机器人训练数据不足的问题——DexMimicGen。在五次演示后,DexMimicGen 能够直接生成 1000 个新的演示数据。

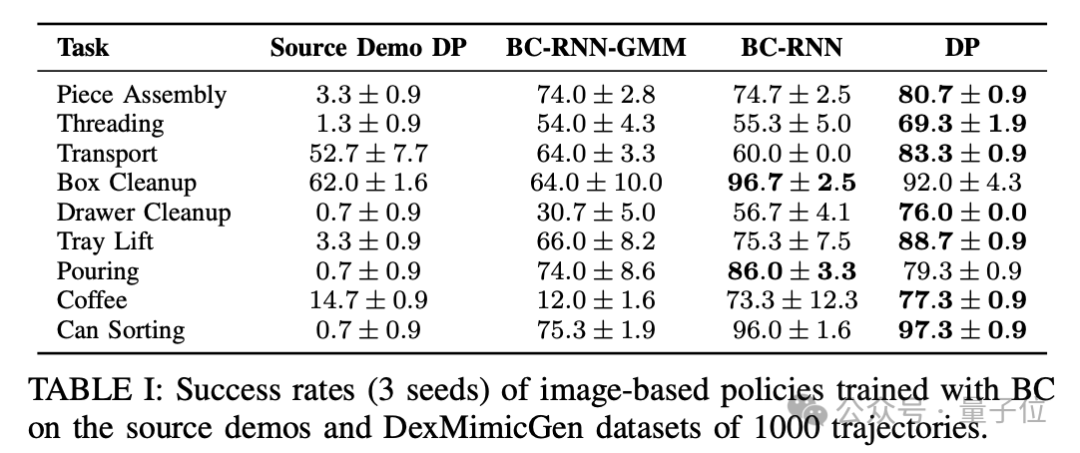

而且这些新生成的演示数据具有很强的可用性,使用这些数据训练的机器人在仿真环境中的任务成功率可高达 97%,甚至超过使用真实人类数据的效果。

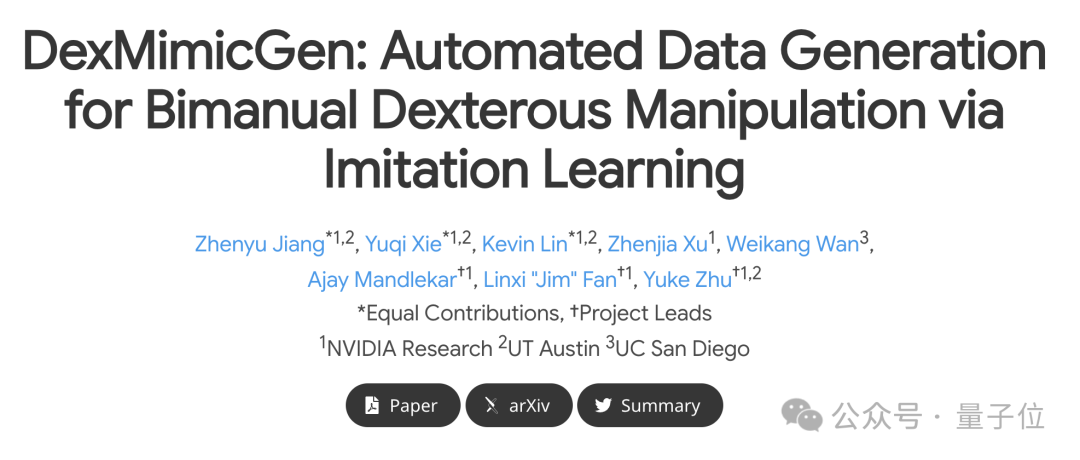

值得注意的是,DexMimicGen 的三位共同作者都是李飞飞的“徒弟”,具体来说是德克萨斯大学奥斯汀分校(UT 奥斯汀)助理教授朱玉可(Yuke Zhu)指导的学生。

而且这三位作者均为华人,目前都在英伟达研究院实习。

5 次演示,生成 1000 条数据

正如所述,DexMimicGen 可以仅通过五次人类演示来生成 1000 个新的演示数据。

在整个实验中,研究人员设置了 9 个场景,涵盖了 3 种机器人形式,共进行了 60 次演示,生成了超过 21000 个演示数据。

在仿真环境中,使用 DexMimicGen 生成的数据训练出的策略执行“整理抽屉”这一任务的成功率可达 76%,而仅使用人工数据的成功率仅为 0.7%。

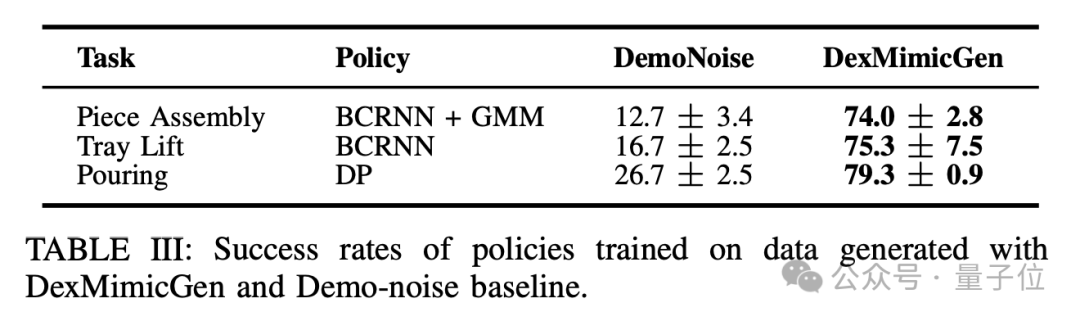

与基准方法相比,DexMimicGen 生成的数据显得更为有效。

当迁移到真实环境时,研究人员测试了易拉罐分拣任务,发现仅使用 40 个生成的数据,成功率就达到了 90%,而不使用生成数据的成功率为零。

此外,DexMimicGen 还展现了跨任务的泛化能力,使得训练出的策略在不同任务中均能取得良好的表现。

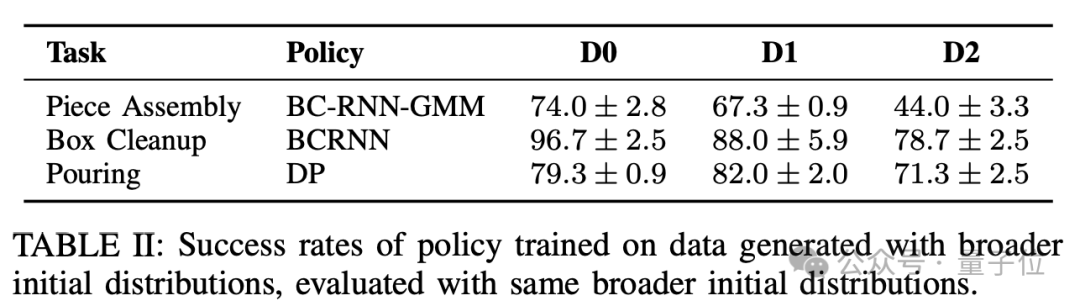

面对初始状态分布的变化,DexMimicGen 也表现出了良好的鲁棒性,在更广泛的初始状态分布 D1 和 D2 的测试中,依然能够保持一定的成功率。

将仿真方法迁移到现实

DexMimicGen 源于 MimicGen 的改进,而 MimicGen 同样由英伟达与 UT 奥斯汀联合团队开发。

朱玉可和范麟熙曾参与 MimicGen 的研究,该成果发表在 CoRL 2023 上。

MimicGen 的核心理念是将人类示范数据划分为以目标物体为中心的片段,然后通过改变物体的相对位置和姿态,在新的环境中重现人类演示轨迹,从而实现自动化数据生成。

而 DexMimicGen 则在 MimicGen 的基础上,针对双臂机器人灵巧操作任务进行了改进和扩展,具体包括以下几个方面:

-

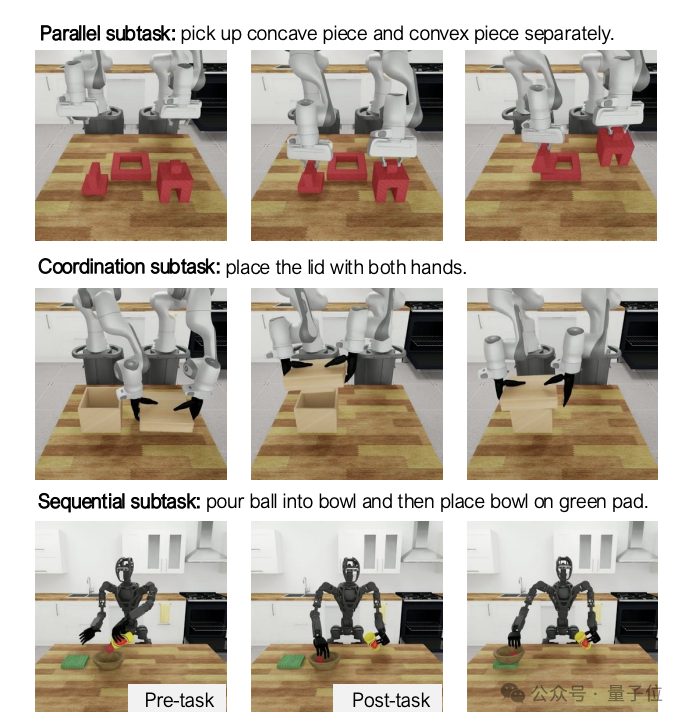

引入并行、协调和顺序三类子任务,以适应双臂灵巧操作的需求;

-

为三种子任务设计了异步执行、同步执行和顺序约束等机制,以实现双臂独立、精确协调以及特定顺序的操作;

-

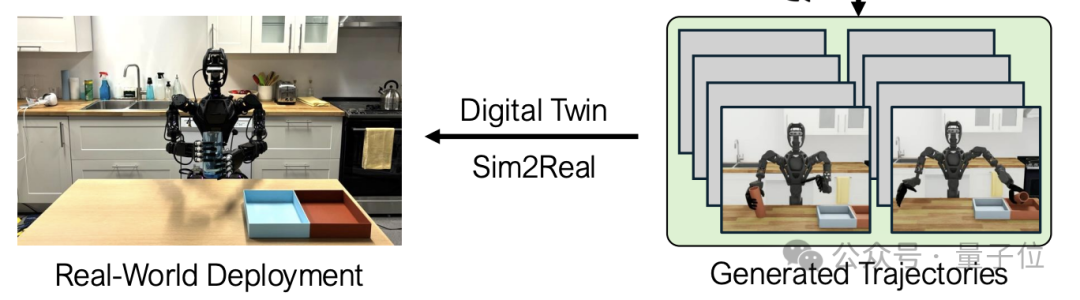

构建“现实-模拟-现实”的框架,通过数字孪生的方式,让 DexMimicGen 跨越到实际机器人系统的应用中。

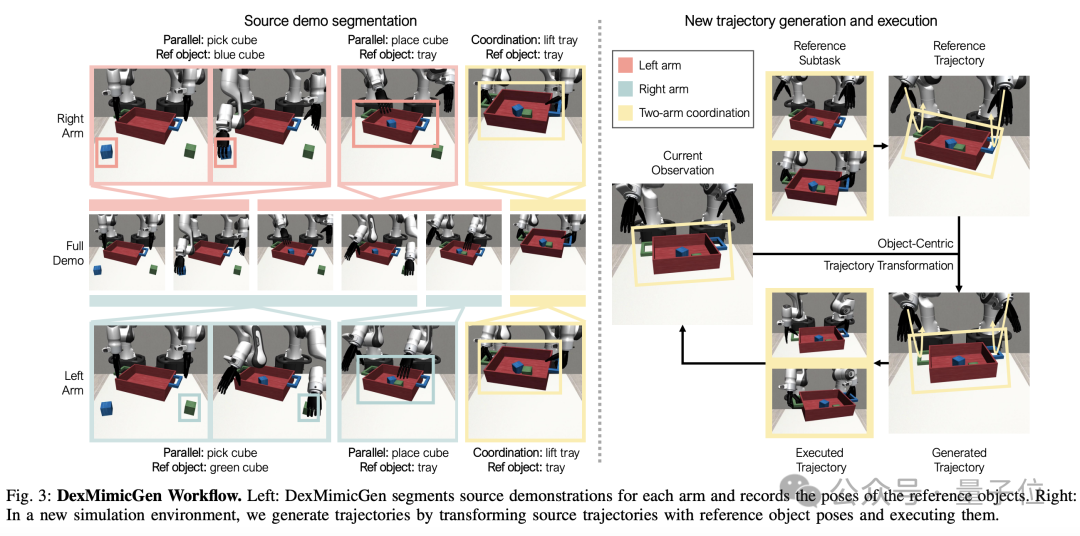

在工作流程上,DexMimicGen 首先对人类示范数据进行采集和划分。

研究人员通过佩戴 XR 头显远程控制机器人完成目标任务,在此过程中会生成一小批示范数据,针对每个任务,研究人员采集了 5 到 10 个示范样本。

这些示范样本会根据并行、协调和顺序三类子任务进行片段划分——

-

并行子任务允许两臂独立执行;

-

协调子任务要求两臂在关键时刻同步动作;

-

顺序子任务规定某些子任务必须在其他子任务完成后才能执行。

总之,在示范数据划分后,机器人的每个手臂将得到对应的片段集合。

在数据生成阶段,DexMimicGen 会随机化模拟环境中物体的位置、姿态,并随机选择一段人类示范作为参考。

对于当前的子任务,DexMimicGen 将计算示范片段与当前环境中关键物体位置和姿态之间的变化。

随后,基于这一变换,对参考片段中的机器人动作轨迹进行处理,以使得变换后的轨迹能够与新环境中的物体位置相匹配。

变换完成后,DexMimicGen 将维护每个手臂的动作队列,手指关节的运动则直接回放示范数据中的动作。

在整个过程中,系统不断检查任务是否成功完成,若一次执行成功,则将执行过程记录下来作为有效的示范数据,若失败则丢弃该数据。接着将生成过程不断迭代,直到获得足够的示范数据。

完成数据收集后,研究人员使用 DexMimicGen 生成的示范数据来训练模仿学习策略,策略的输入为 RGB 相机画面,输出为机器人动作。

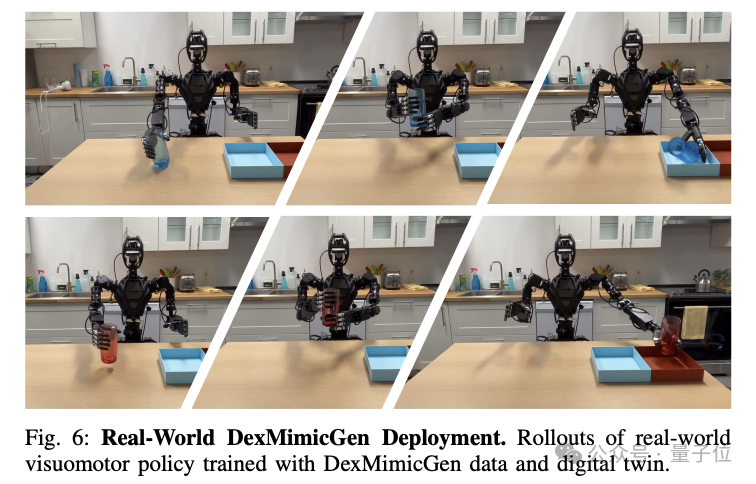

最后是模拟到现实的迁移,研究人员同样使用 DexMimicGen 在数字孪生环境中生成的海量演示数据来训练模仿学习策略。

之后,研究人员对在数字孪生环境中评估的训练策略进行调优,以提高其泛化能力和鲁棒性,并将其迁移至实际机器人系统中。

作者简介

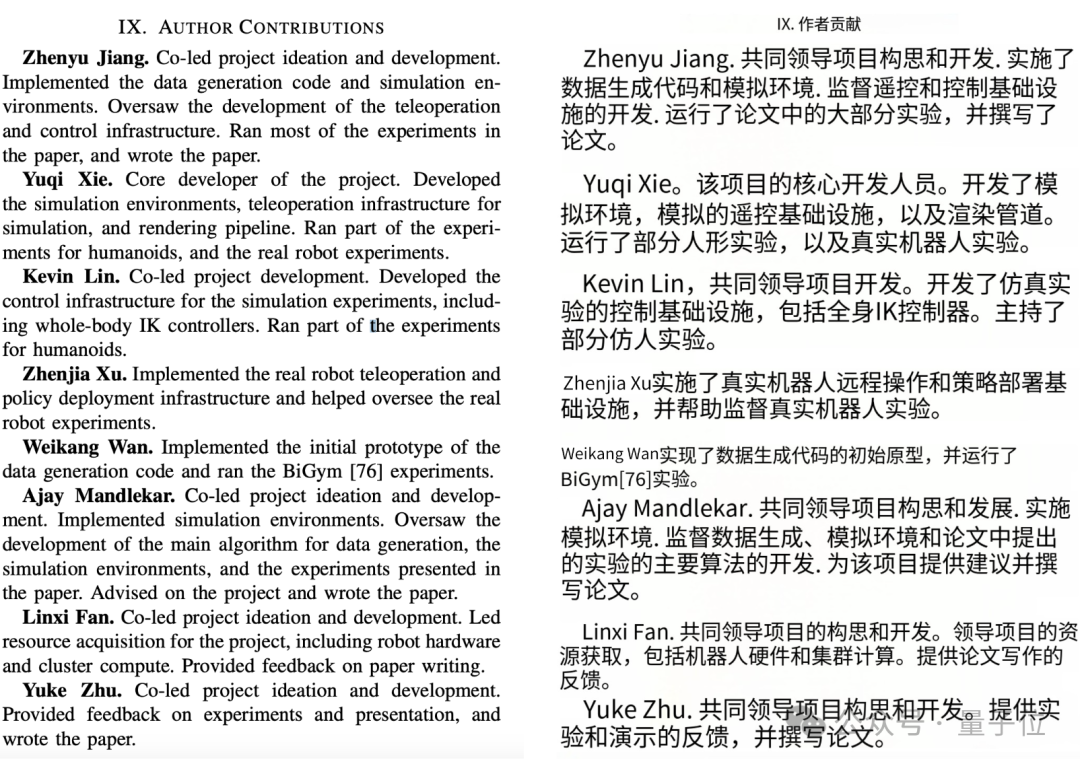

DexMimicGen 由三位共同作者开发,他们都是 UT 奥斯汀的华人学生。

三位作者均是李飞飞的学生、浙大的校友,具体为朱玉可(Yuke Zhu)助理教授的学生,他们分别是:

-

博士生 Zhenyu Jiang,曾就读于清华,2020 年入读 UT 奥斯汀,预计明年毕业;

-

硕士生 Yuqi Xie(谢雨齐),本科为上海交通大学和美国密歇根大学的联合培养,预计也将于明年毕业;

-

博士生 Kevin Lin,曾在 UC 伯克利和斯坦福完成本硕教育,今年加入朱玉可教授的课题组攻读博士。

朱玉可同时也是英伟达的研究科学家,团队的另外两位负责人同样在英伟达工作。

他们分别是 Ajay Mandlekar 和范麟熙(Jim Fan),也是李飞飞的学生,Mandlekar 是 DexMimicGen 项目组中唯一的非华人。

此外,Zhenjia Xu 和 Weikang Wan 两名华人学者对此项目也有贡献,整个团队的分工如下:

项目主页:

论文地址:

参考链接:

-

[1]https://x.com/SteveTod1998/status/1852365700372832707

-

[2]https://x.com/DrJimFan/status/1852383627738239324

本文来自微信公众号:量子位(ID:QbitAI),作者:克雷西,原标题《英伟达团队机器训练新方法!仅 5 次演示让机器生成 1000 个新 demo,李飞飞高徒与徒孙联手出品》