Meta 公布机器人触觉感知能力研究成果:利用手指传感器结合“AI 大脑”理解 / 操作外界物体

GoodNav 11月4日报道,Meta 发布了一份新闻稿,透露其 FAIR(基础人工智能研究)团队在机器人触觉感知能力方面的研究进展,此项研究旨在帮助机器人通过触摸来更好地理解和操作外部物体。

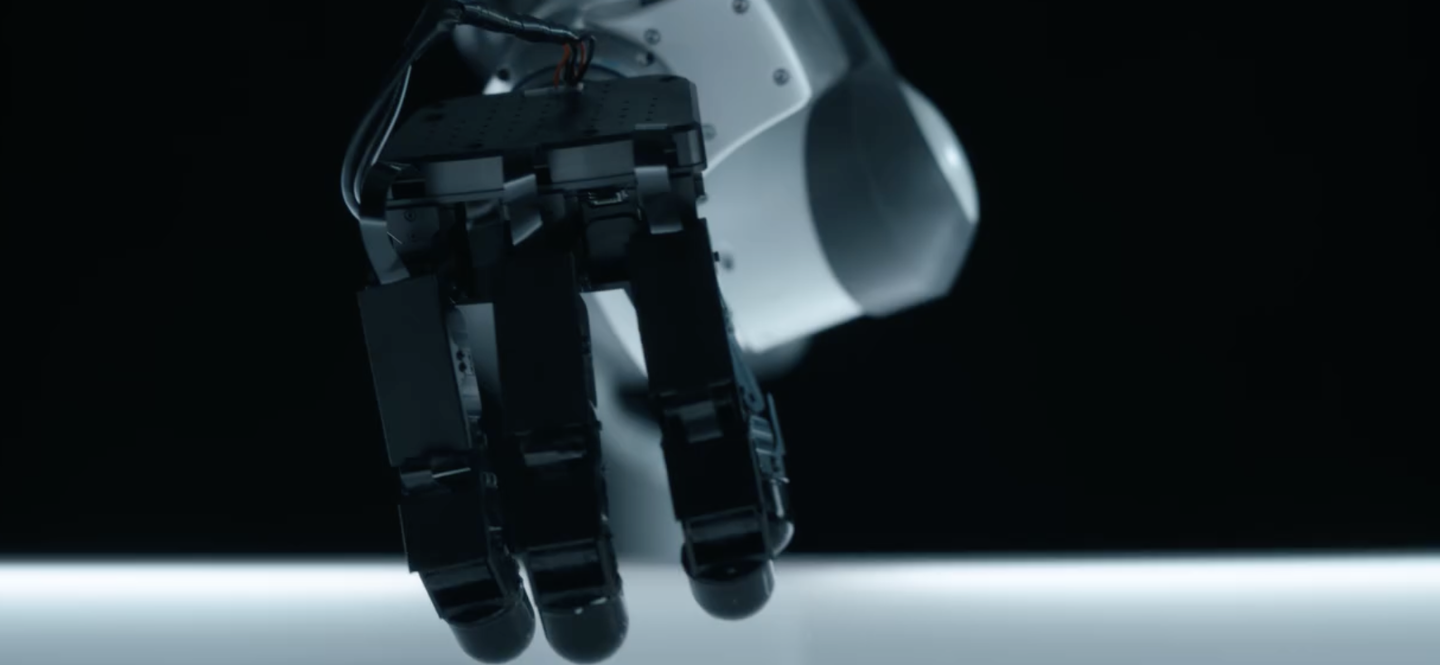

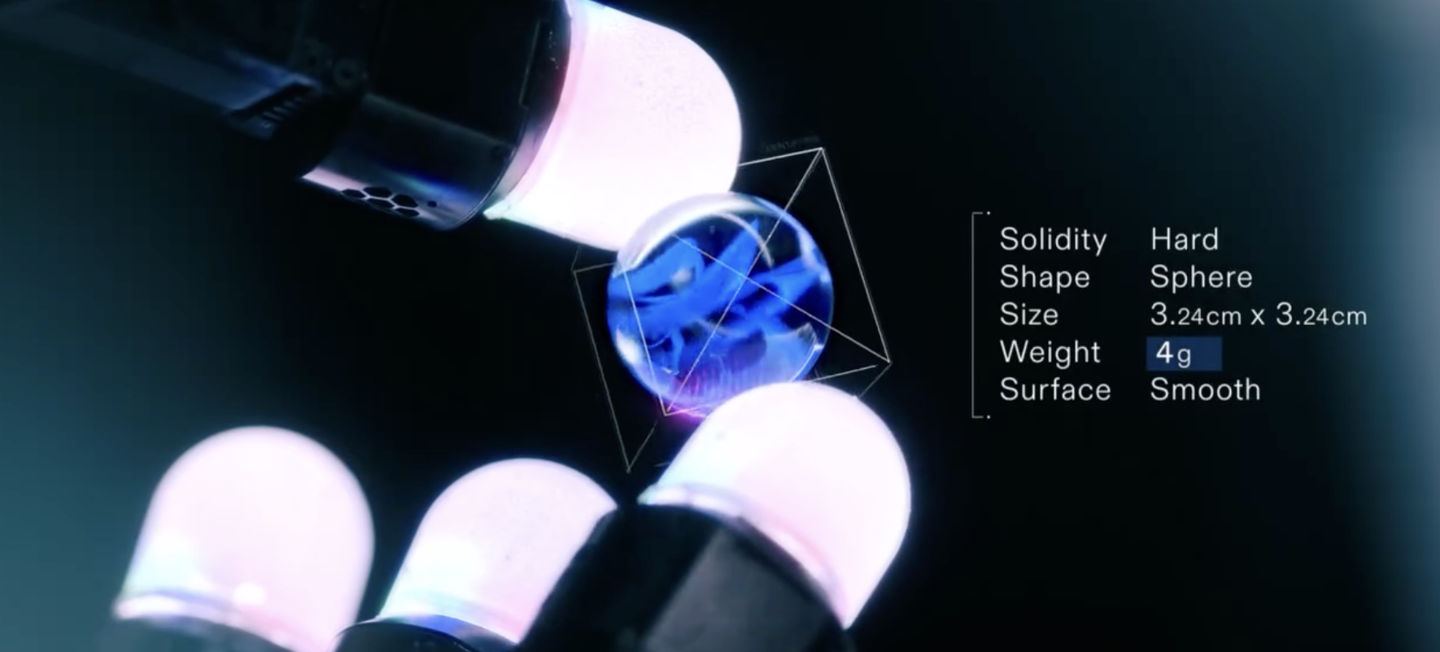

Meta 指出,开发这一类 AI 机器人的关键在于使其传感器能够理解物理世界,并依赖“AI 大脑”准确控制机器人对物理世界的反应。目前,团队所研发的机器人触觉感知能力主要是为了让机器人能够识别与其互动对象的材质与触觉,从而使 AI 能够判断机器人在不同场景中应如何操作这些物体(例如拿起鸡蛋等情境)。

根据 Meta 提供的资料,目前已发布的研究成果包括 Meta Sparsh、Digit 360 和 Meta Digit Plexus等。其中,Meta Sparsh 是一种基于 AI 的触觉编码器,利用 AI 的自我监督学习能力实现跨场景的触觉感知,让机器人的 AI 大脑在学习某一物体的“触感”后,可以灵活地“感知”相关物品在不同场合的特性。

而 Digit 360 是一种高精度传感器,主要安装在机器人手指上,具备多模态感知能力,能够捕捉细微的触觉变化。Meta 声明,这种传感器可以模拟人类的触觉,支持振动、温度等多种感知功能。

Meta Digit Plexus 是一个开放平台,声称能够整合多种传感器,使机器人更加全面地感知其周围环境,并通过统一的标准实时与 AI 大脑进行互动。

此外,Meta 还开发了 PARTNR 基准,这是一个评估人机协作能力的测试框架,旨在新的生活场景中测试机器人 AI 系统的计划和推理能力,框架中嵌入了10万个自然语言任务,可以模拟家庭环境中的各种情况,帮助开发者评估机器人对自然语言的理解与执行能力。

Meta 现已将这些技术与数据对外公开供研究人员使用,包括论文、开源代码和模型等,鼓励更多的研究社区参与触觉技术的创新研究,相关项目地址如下(点此访问)。