OpenAI 升级 Whisper 语音转录 AI 模型,不牺牲质量速度快 8 倍

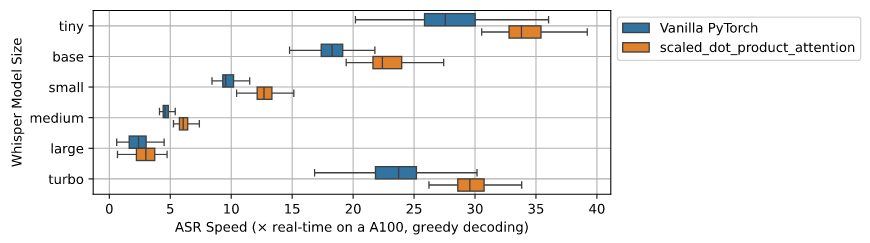

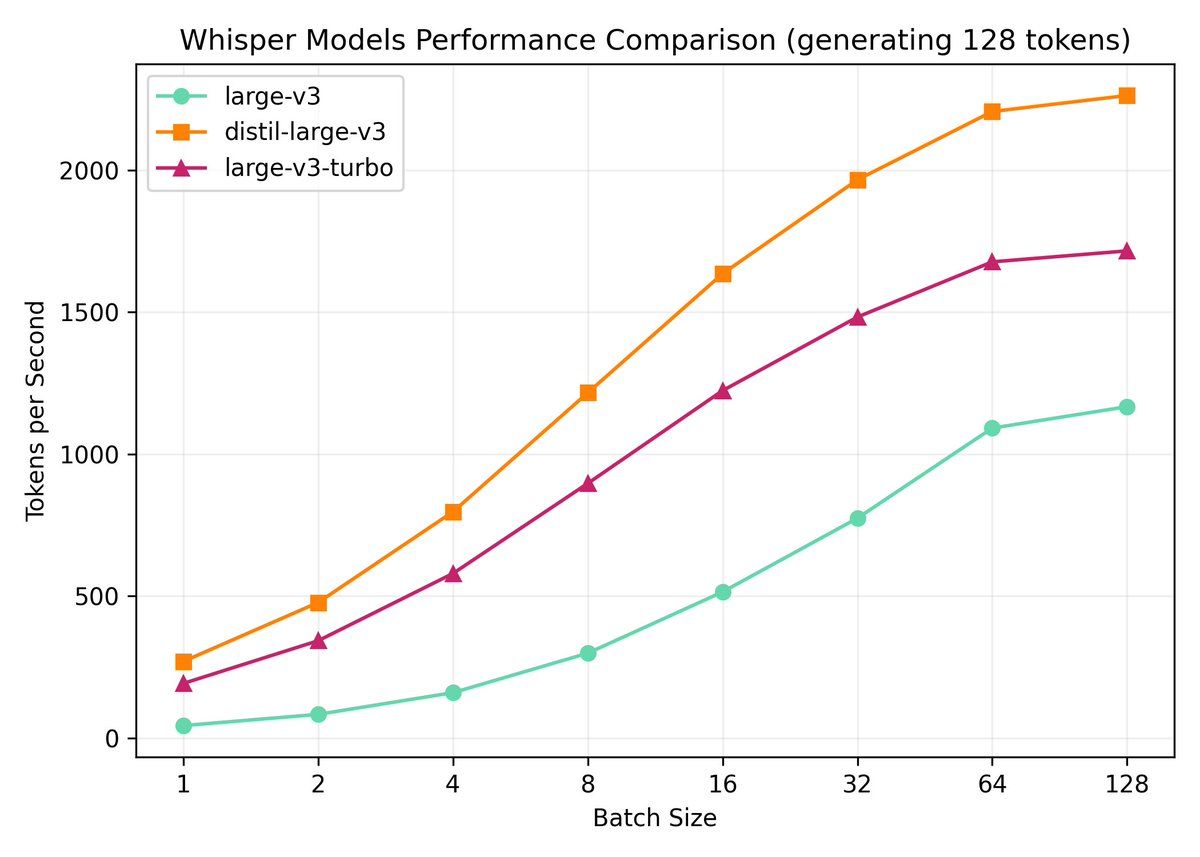

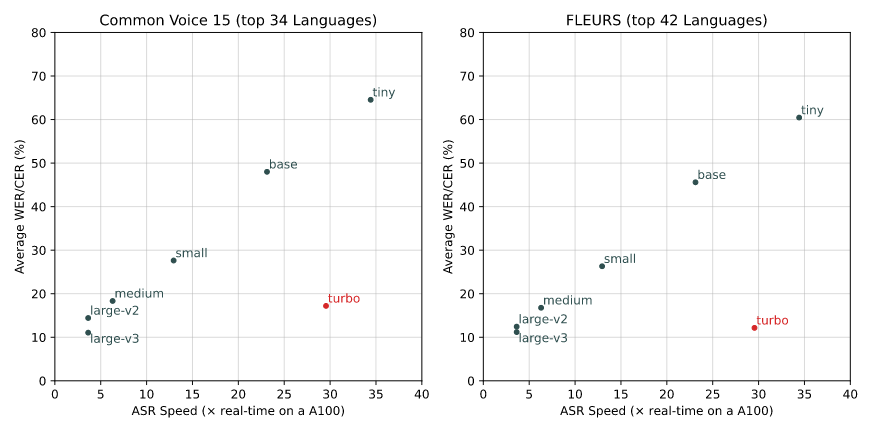

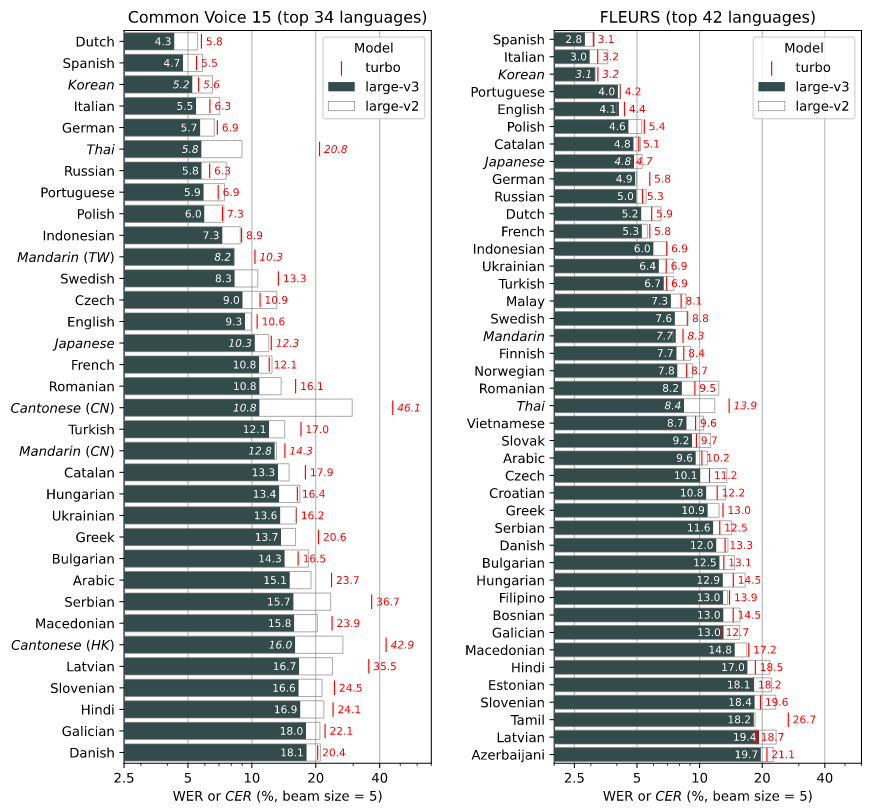

GoodNav 10 月 3 日报道,OpenAI 在 10 月 1 日的 DevDay 活动中,宣布推出了 Whisper large-v3-turbo 语音转录模型,该模型拥有 8.09 亿参数,且在几乎不降低质量的情况下,速度比 large-v3 快 8 倍。

Whisper large-v3-turbo 是 large-v3 的优化版本,具有仅 4 层解码器层(Decoder Layers),而 large-v3 则有 32 层。

Whisper large-v3-turbo 语音转录模型的参数量为 8.09 亿,略大于 7.69 亿参数的 medium 模型,但远小于 15.5 亿参数的 large 模型。

OpenAI 表示 Whisper large-v3-turbo 的速度是 large 模型的 8 倍,并且所需的 VRAM 为 6GB,而 large 模型则需要 10GB。

Whisper large-v3-turbo 语音转录模型的大小为 1.6GB,OpenAI 继续根据 MIT 许可证提供 Whisper(包括代码和模型权重)。

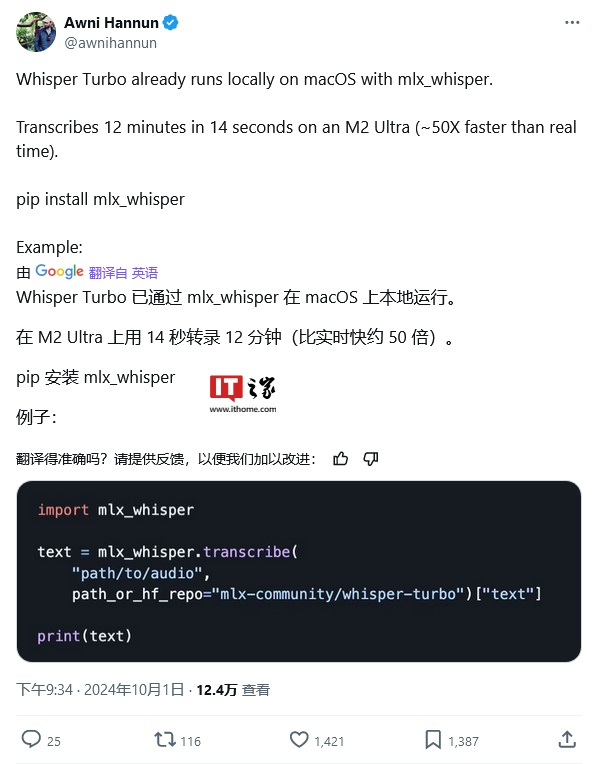

根据 Awni Hannun 的测试结果,在 M2 Ultra 上,12 分钟的内容转录仅需 14 秒。

GitHub:https://github.com/openai/whisper/discussions/2363

模型下载:https://huggingface.co/openai/whisper-large-v3-turbo

在线体验:https://huggingface.co/spaces/hf-audio/whisper-large-v3-turbo</p

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...